Il faudra rafraîchir la page manuellement pour constater que le noeud à bien été ajouté au cluster après le plantage de Proxmox (un message **Connection Error** devrait apparaître en fond).

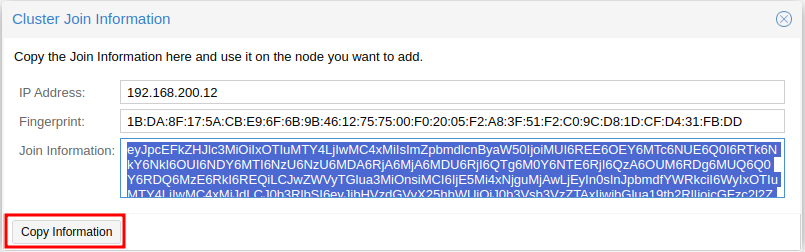

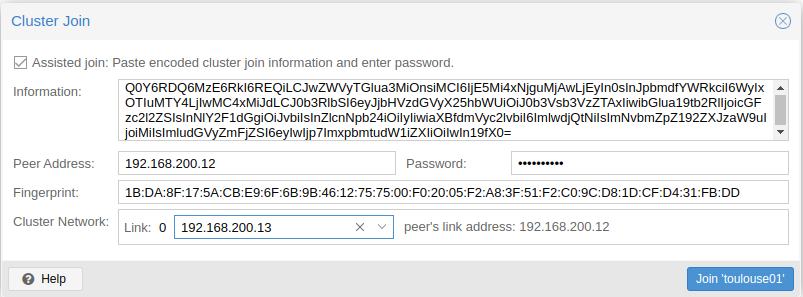

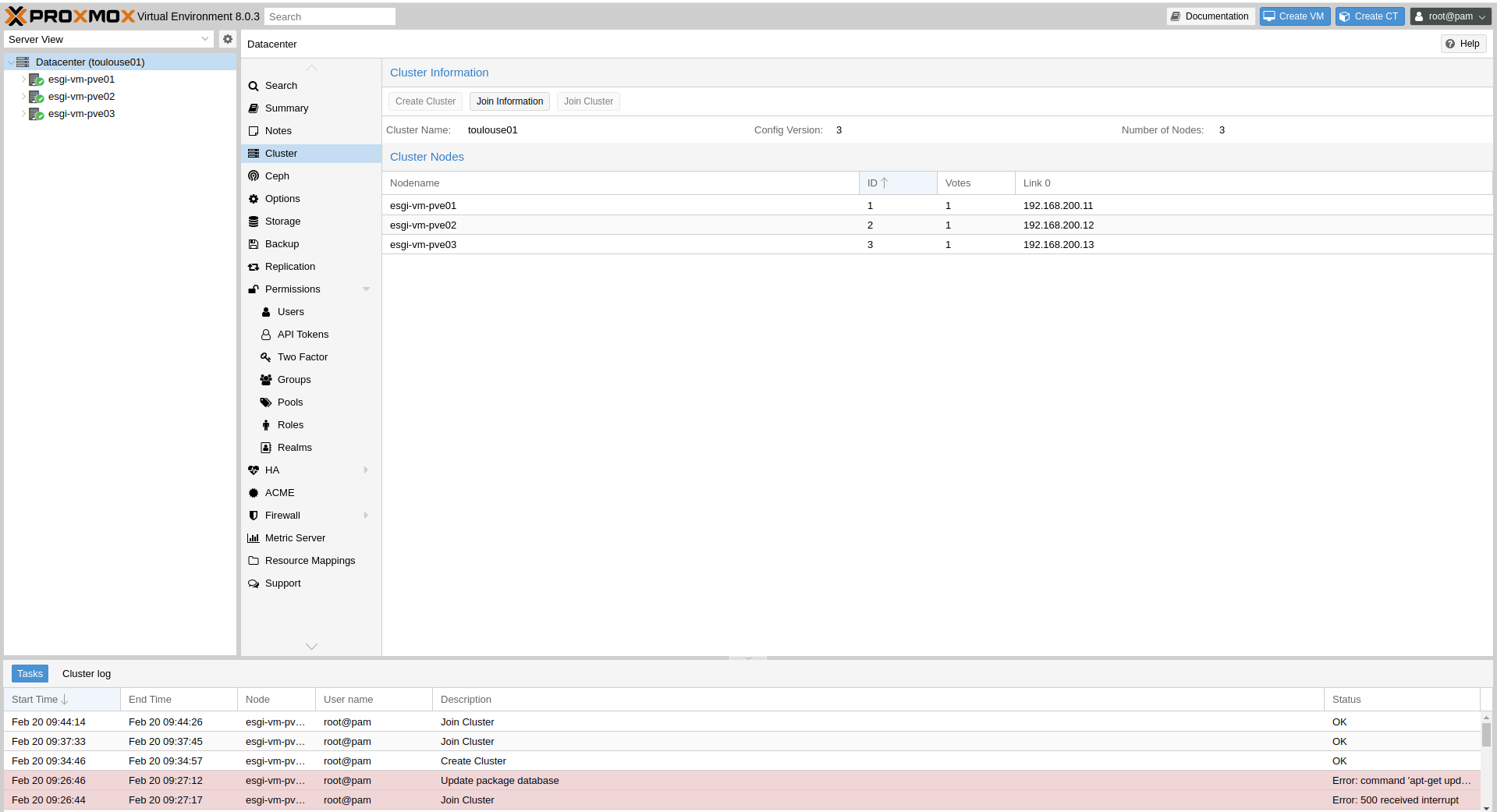

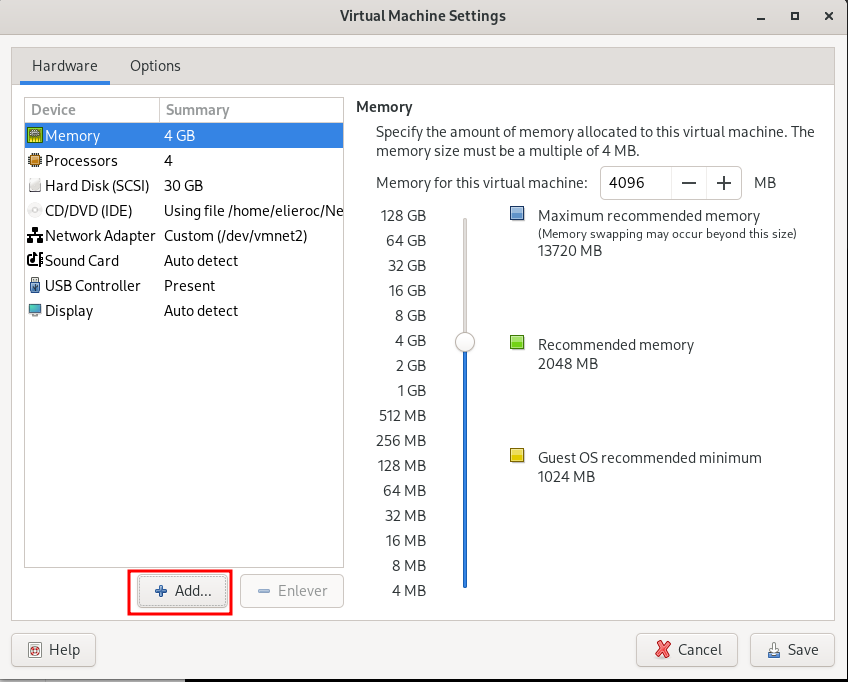

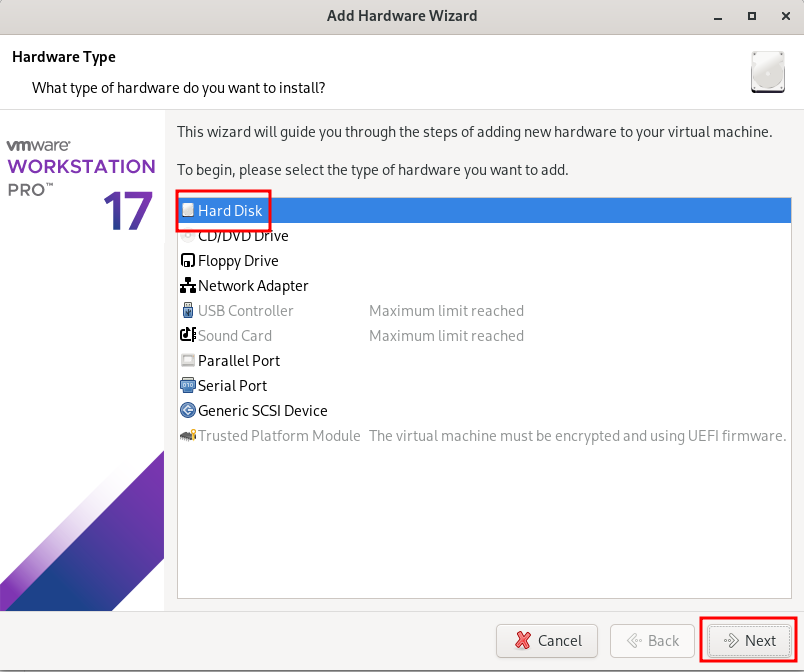

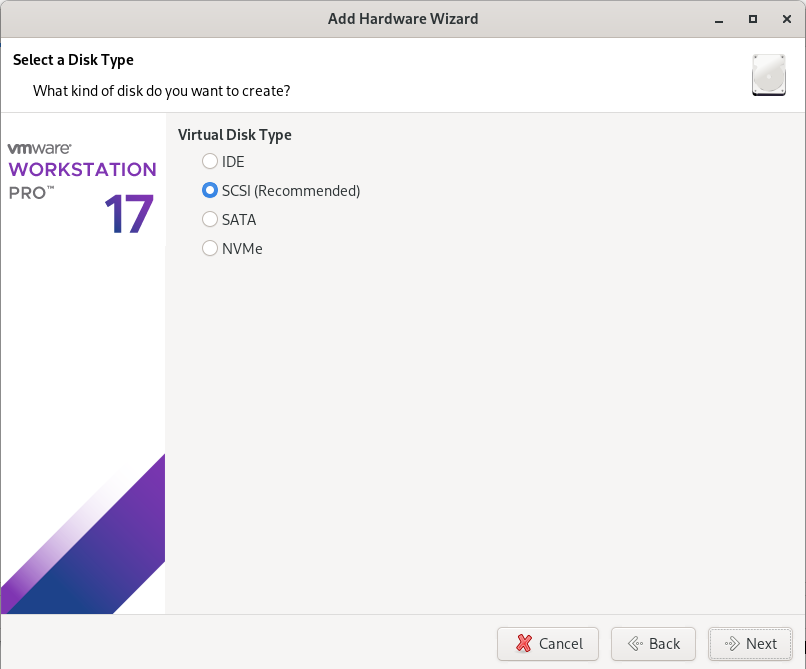

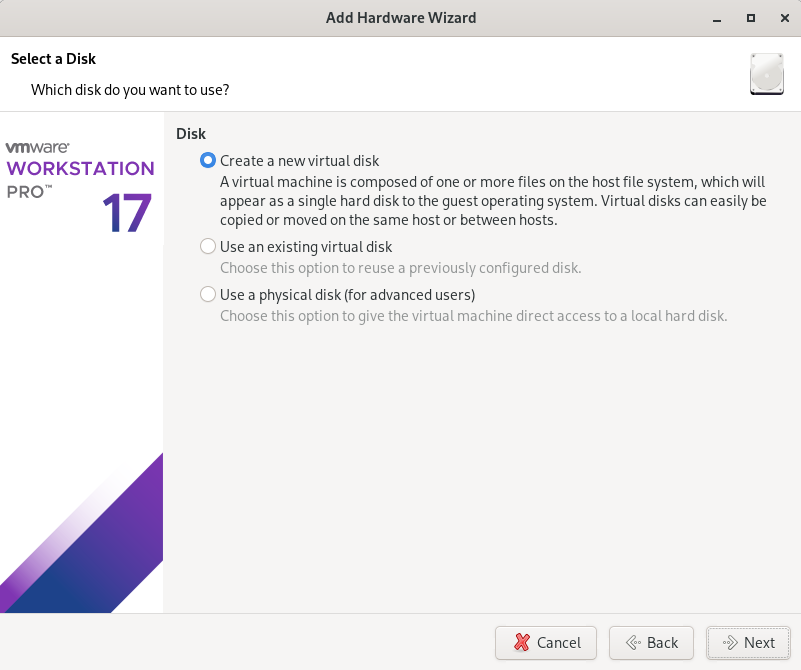

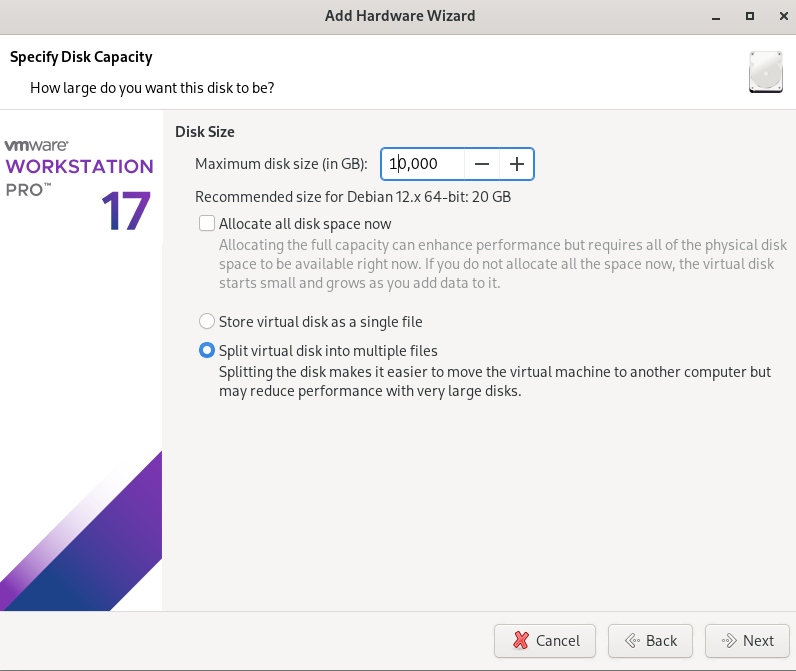

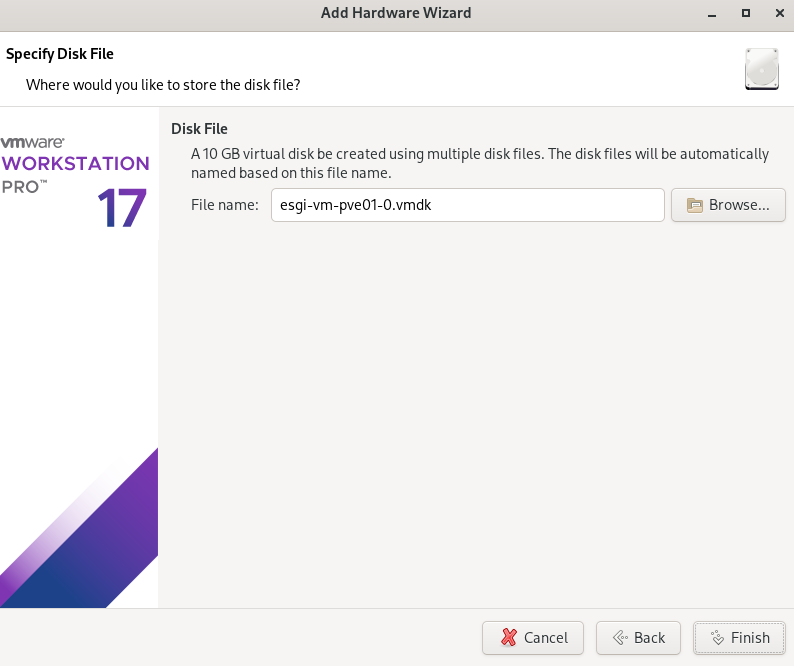

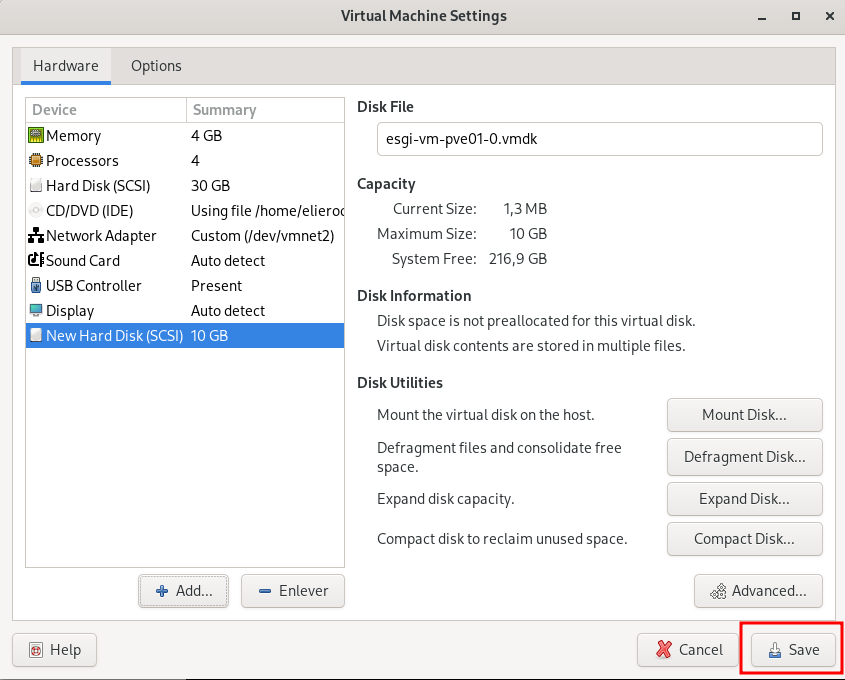

On peut réitérer les opération faites sur le Node 2 sur le **Node 3** pour qu'il puisse à son tour rejoindre le Cluster :  [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/OR3image.png) Si on se reconnecte sur un des trois noeuds, on s'aperçoit que le cluster est créé et fonctionnel : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/Zk3image.png) # [Proxmox] CEPH et HA ## Introduction La mise en place de **CEPH** vous permet d'avoir un disque partagé entre les noeuds de votre cluster Proxmox. Cela sera utile notamment pour la haute disponibilité (**HA**) que l'on mettra en place dans un second temps. [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/5z2image.png) ## Prérequis - [Installer un cluster Proxmox](https://wiki.neopipe.fr/books/proxmox/page/proxmox-cluster) ## Installation de CEPH #### Ajout des disques et carte réseaux CEPH La première étape va être d'ajouté un disque partagé dans chacun des noeuds du cluster. J'utilise un environnement **VMware** mais on peut très bien le faire avec des disque physiques sur des serveurs dans une baie : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/2KYimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/pe1image.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/qZBimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/VL7image.png) J'ajoute un disque d'une taille de **10Go** : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/8nAimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/oCHimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/rCCimage.png)Puis on réitère l'opération sur chacun des noeuds du cluster Proxmox.

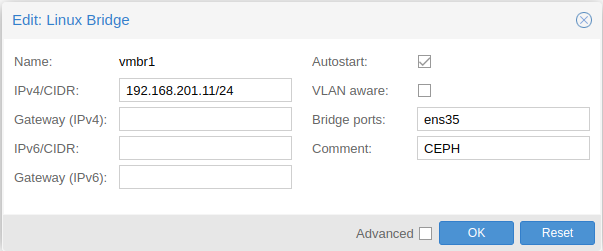

Désormais, il faut ajouter une carte réseau sur chaque noeud pour le **réseau CEPH** (192.168.201.0/24) et ajouté un Linux Bridge sur chacun des noeuds Proxmox : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/vw7image.png)N'oubliez pas d'appliquer la configuration réseau en appuyant sur **Apply configuration**.

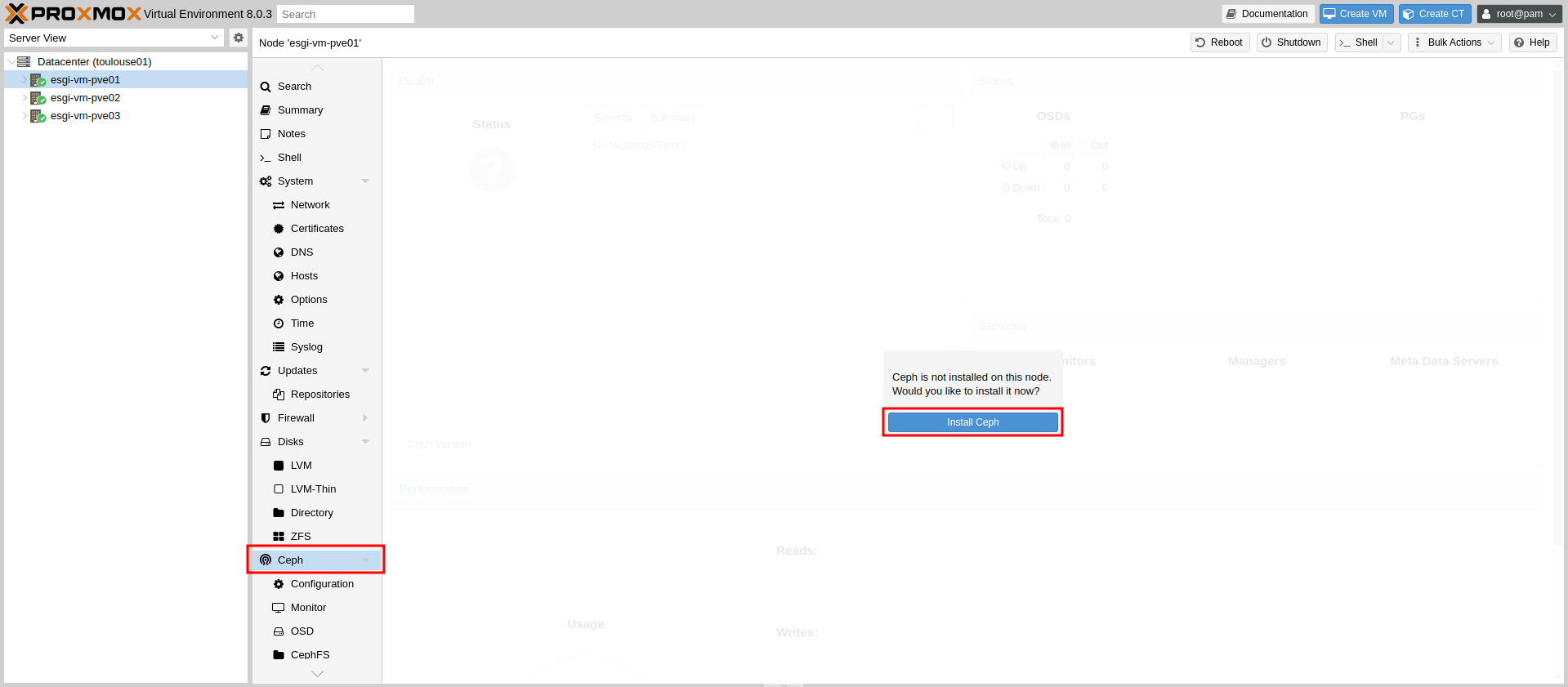

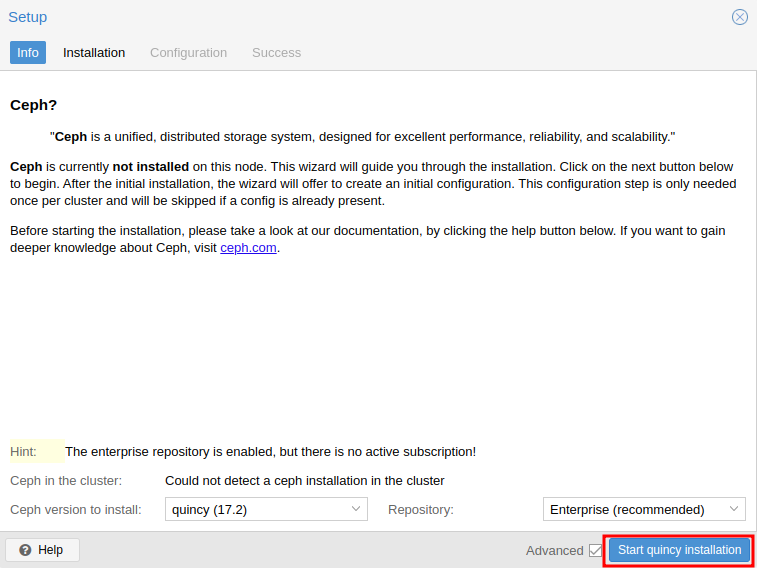

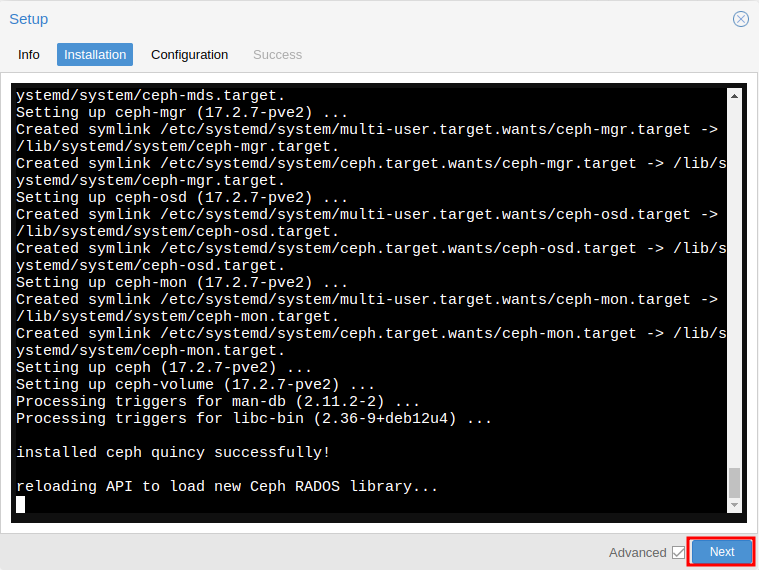

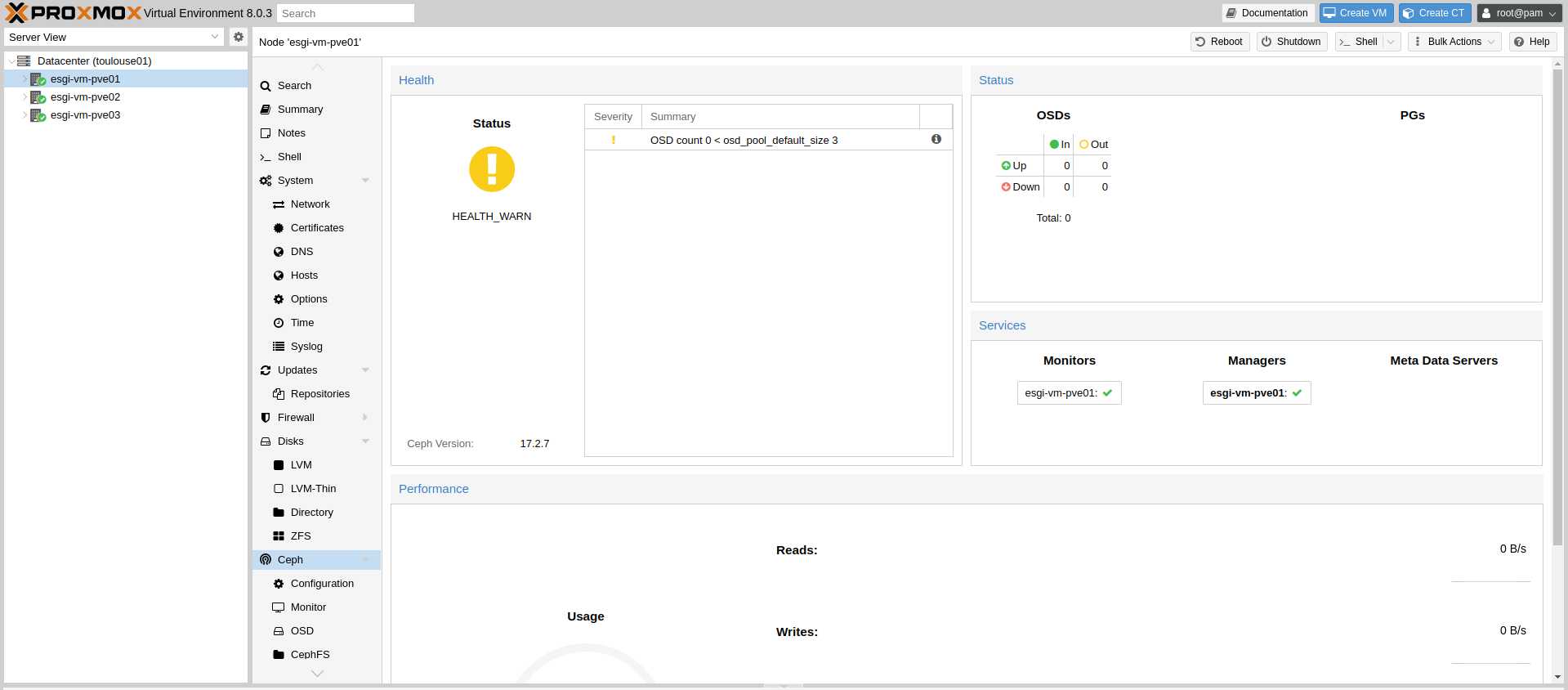

#### Installation de CEPH sur les noeuds Une fois les VMs redémarrées avec leur nouveau disque et nouvelle carte réseau, rendez-vous sur le **Node 1** dans l'onglet et cliquer sur **Installer CEPH** :  Puis on peut lancer l'installation de la version actuelle de CEPH (**quincy** dans notre cas) :  Une fois l'installation terminée, on clique sur **Next** :  L'écran de configuration de CEPH devrait s'ouvrir et vous devrez sélectionner l'interface du réseau CEPH. Vous devriez voir cette configuration : Pour le moment, l'état de santé n'est pas bon puisque nous avons pas de stockage CEPH définit.

Maintenant, il faut réitérer l'installation de CEPH sur chacun des noeuds du cluster.

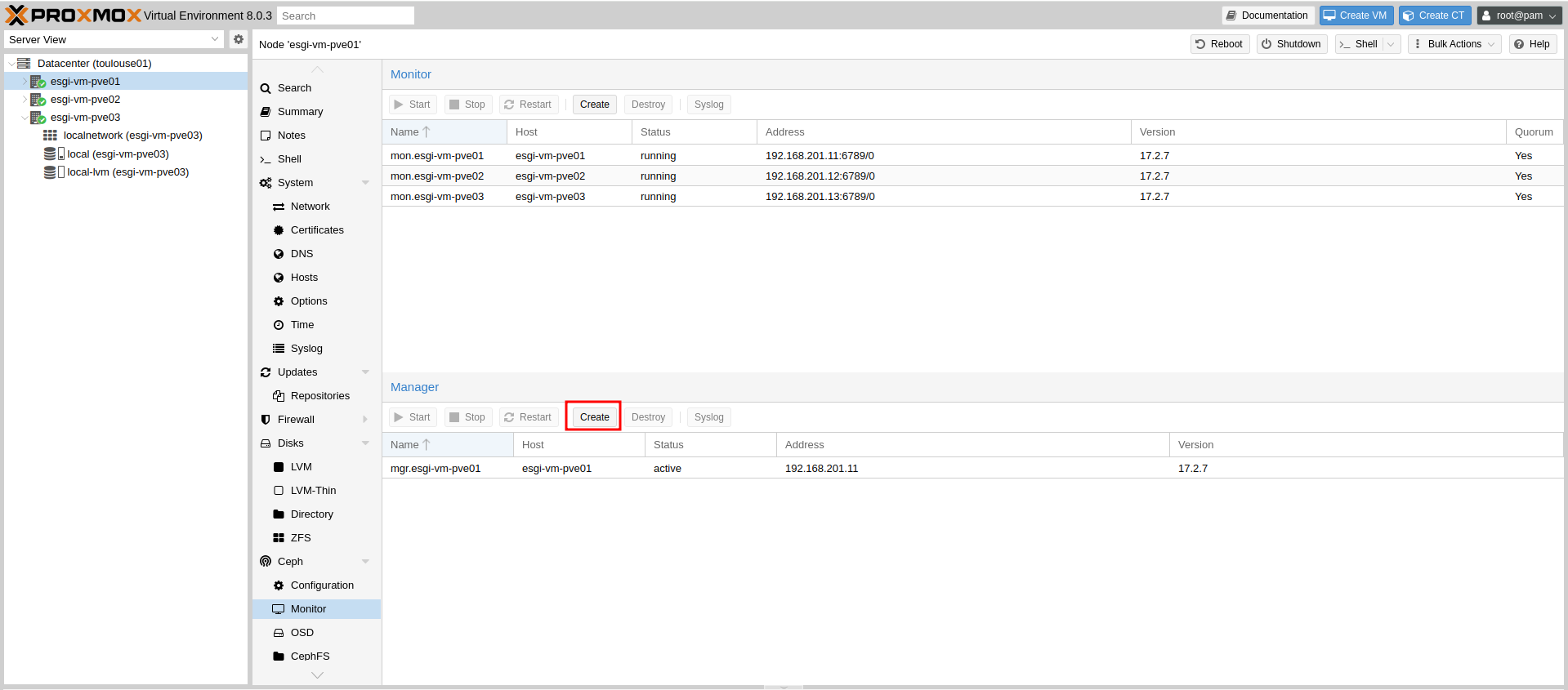

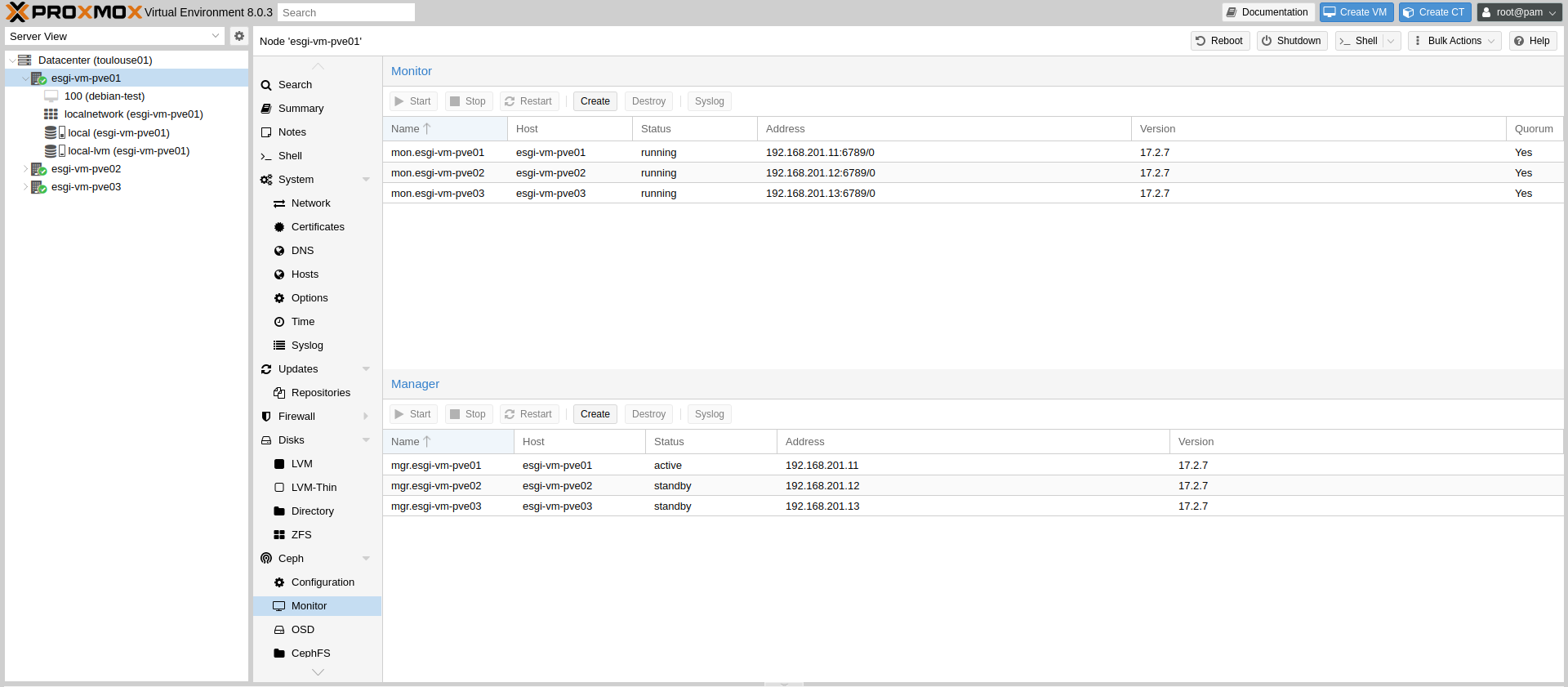

#### Configuration des Moniteurs et Managers Désormais ce qui est recommandé, c'est de configurer chacun des noeuds avec le rôle **Monitor** et **Manager** pour qu'on puisse avoir de la surveillance du pool même si un des noeud tombe.\*Par défaut, le Node 1 possède déjà les rôles Monitor et Manager.

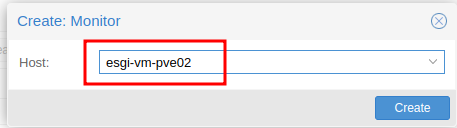

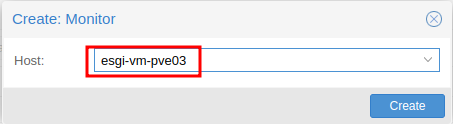

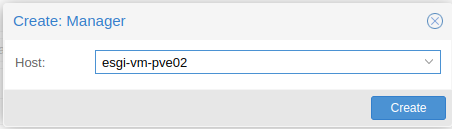

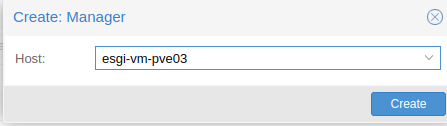

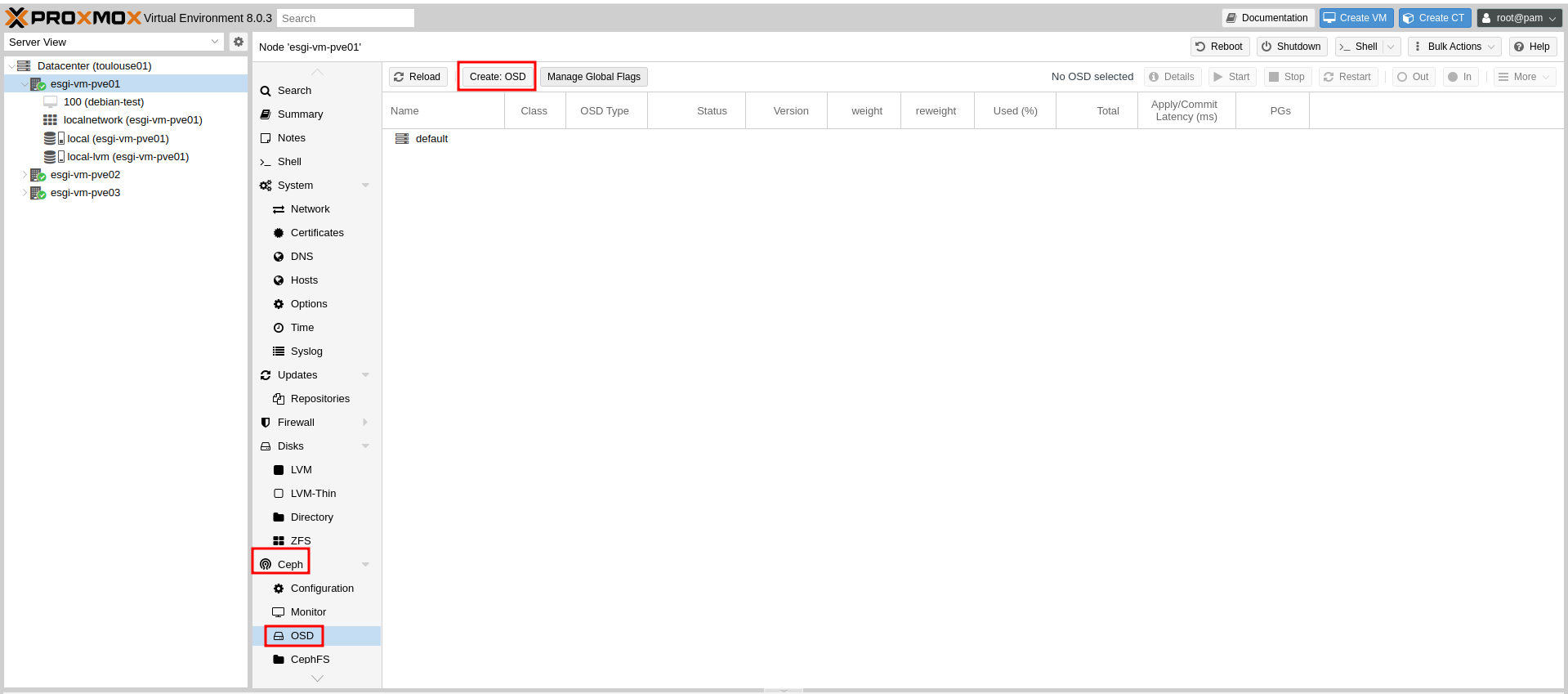

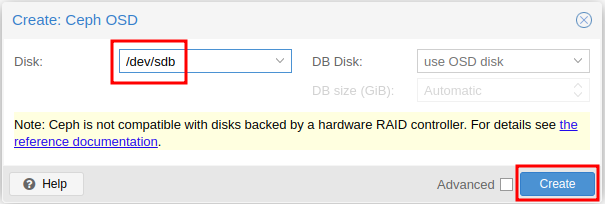

On commence par aller sur le **Node 1** dans **CEPH > Moniteur** puis **Créer** : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/pnaimage.png) On sélectionne d'abord le **Node 2** :  Puis le **Node 3** :  Et on fait de même pour le rôle **Manager** qui est juste en dessous avec nos **Node 2 et 3** : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/AbEimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/Wqyimage.png)[](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/LrCimage.png) Au final vous devriez avoir cette configuration :  #### Création des OSDs Les OSDs sont les disques partagés CEPH. On va commencer par configurer un OSD sur le **Node 1** en allant dans **CEPH > OSD** puis **Create OSD** :  On peut sélectionner le disque sur lequel on souhaite installer CEPH (**/dev/sdb** dans notre cas) : Réitérer l'opération sur chacun des noeuds du cluster.

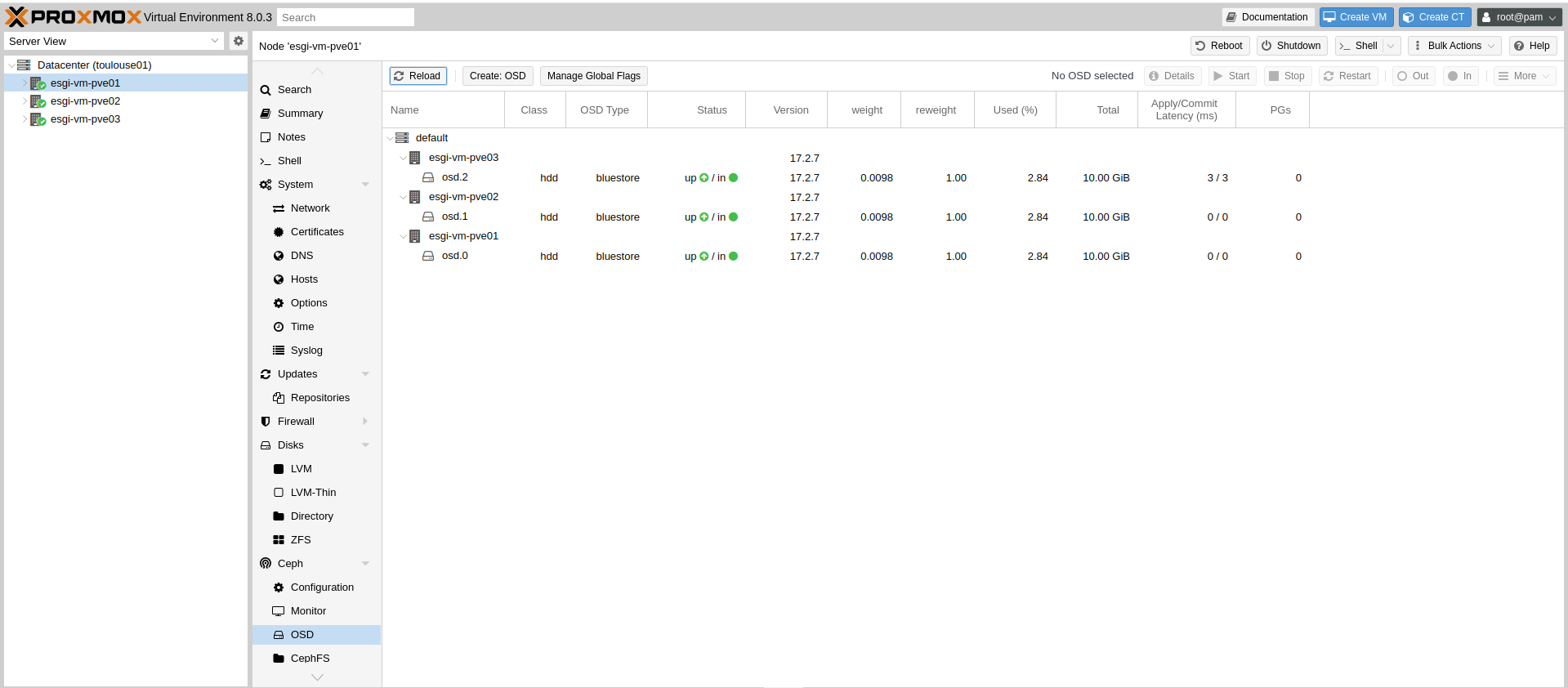

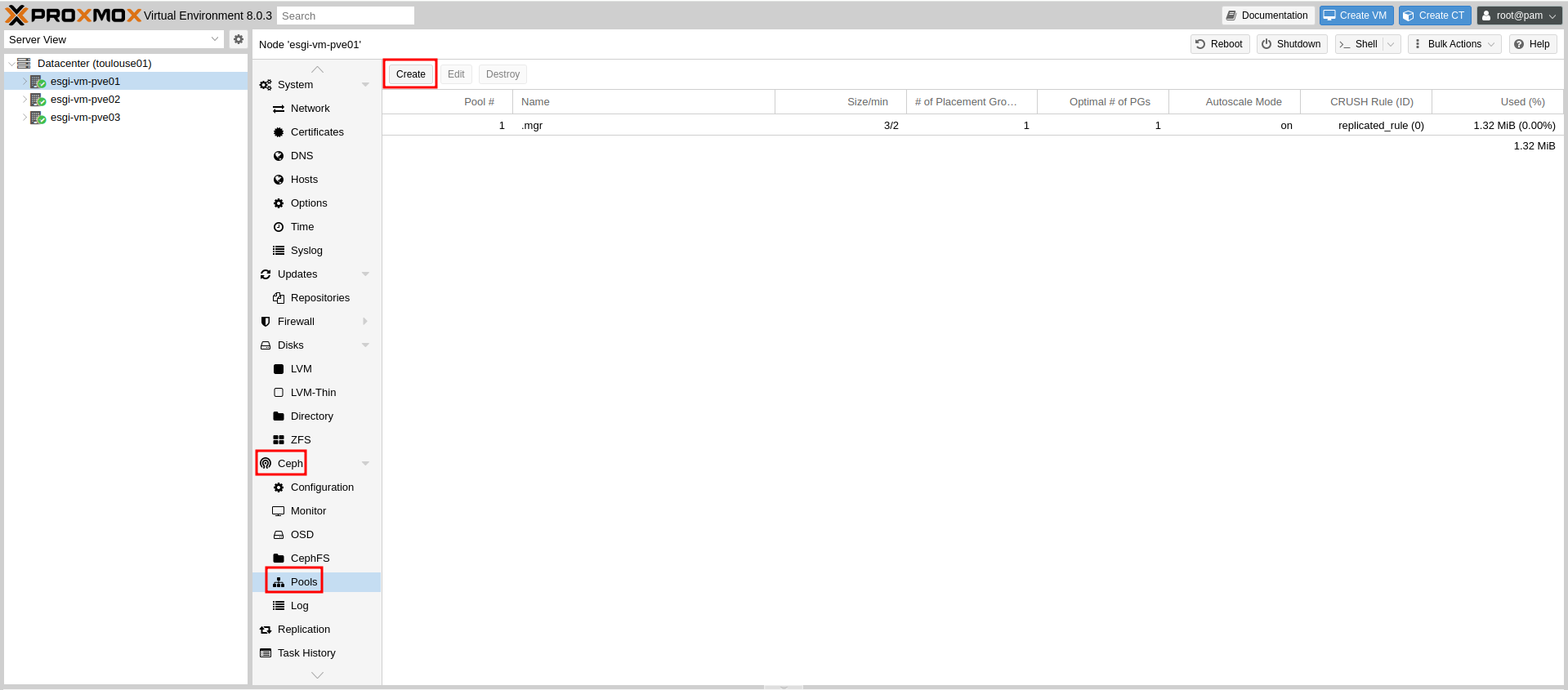

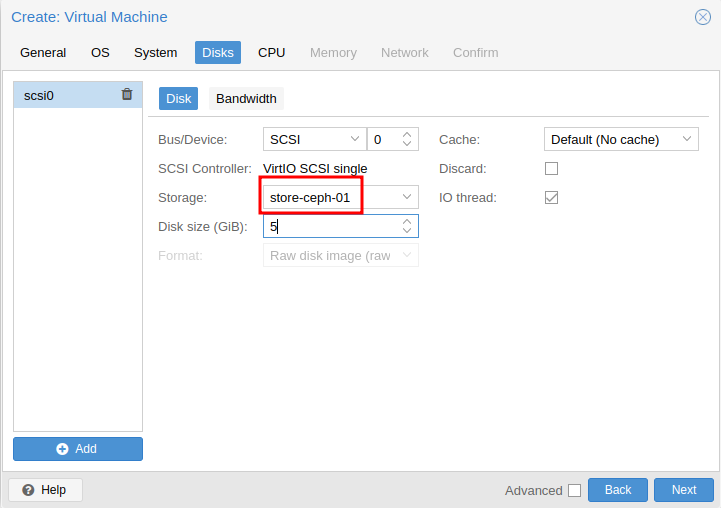

Vous devriez avoir la configuration suivante :  #### Création du pool de stockage L'objectif va être de créer un groupe (pool) d'OSDs qui sera utilisé par nos VMs. Pour cela, on se rend sur le **Node 1** dans **CEPH > Pools** puis **Create** :  On choisit un **nom** ainsi que la **taille** du pool qui correspond au nombre d'OSD présent dans le pool : La **taille minimale** (Min Size) signifie que le pool continuera de fonctionner avec seulement 2 noeuds sur 3 disponibles.

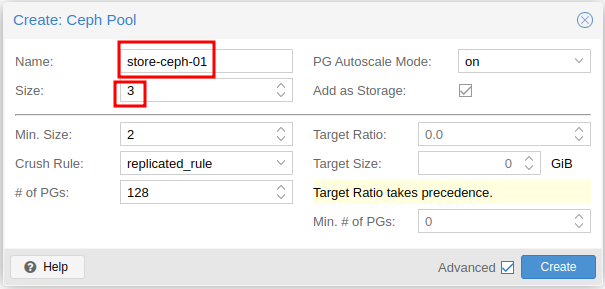

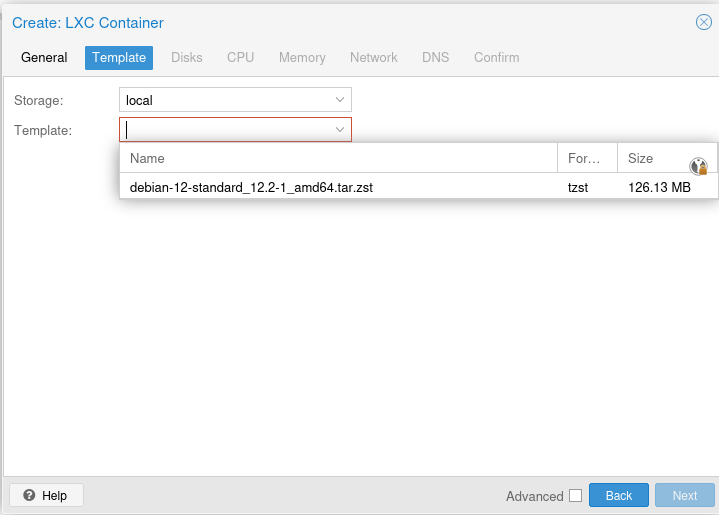

Le stockage CEPH devrait apparaître sur chacun des noeuds : ##  ## Installation de la Haute Disponibilité (HA) #### Création de la VM pour la HA Nous allons créer une VM qui prendra en charge la **HA**, ce qui signifie qu'elle sera automatiquement répliquée sur le une autre noeud si le noeud principal de VM venait à devenir défaillant.La migration ne sera effective que si les lecteurs **CD** sont supprimés des VMs sinon elle échouera systématiquement.

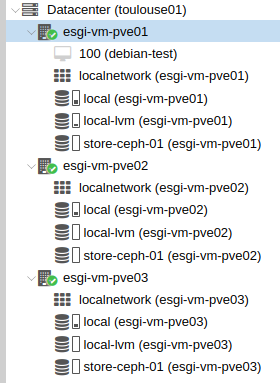

Pour cela nous allons créer une VM de manière standard mais nous allons l'installer sur le **stockage CEPH** : Vous pouvez créer et installer votre VM normalement, la configuration de la HA viendra après ces étapes.

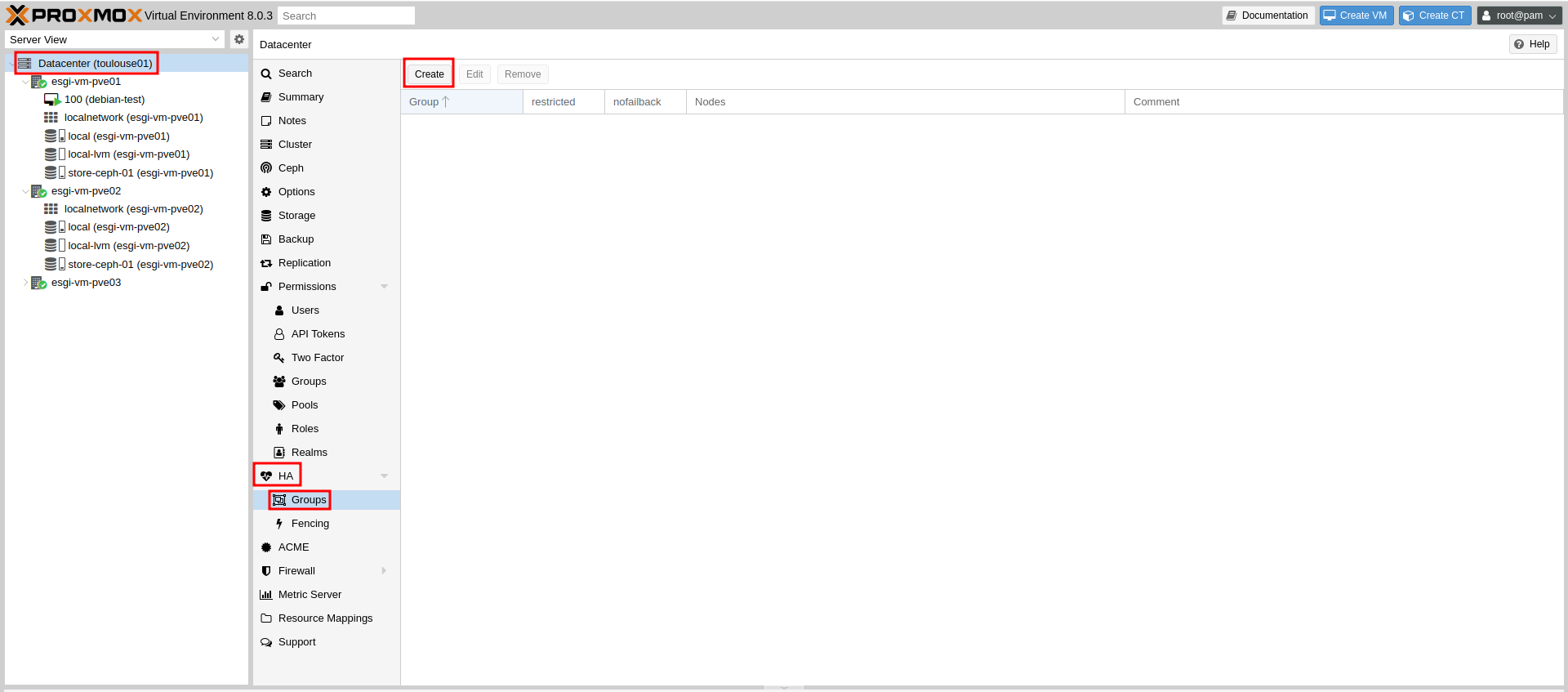

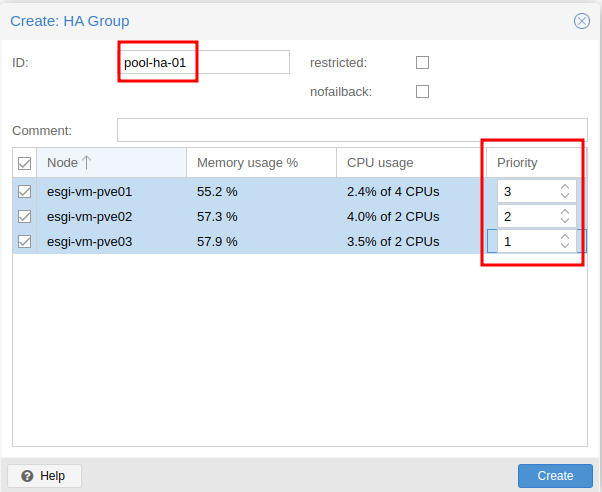

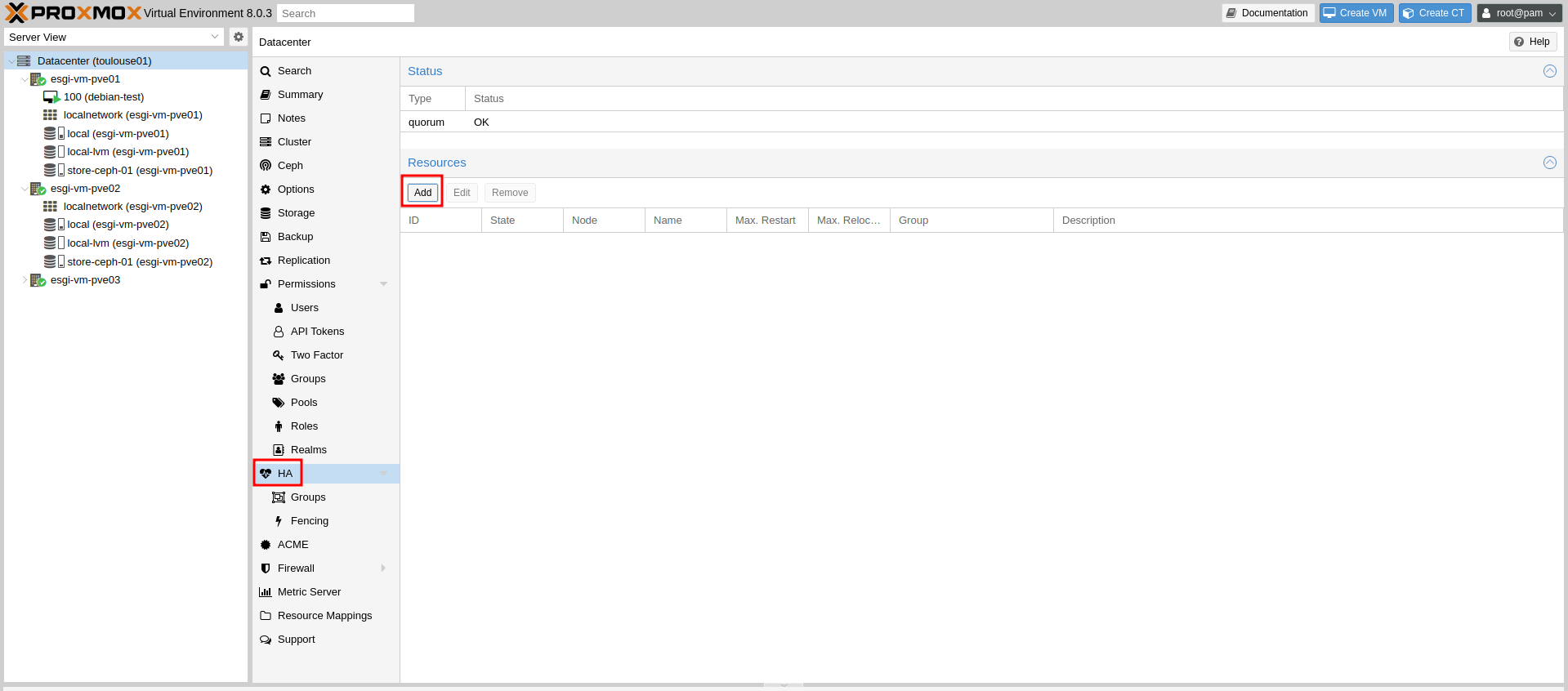

#### Configuration de la HA sur le cluster Désormais, on va configurer la HA sur le cluster. Pour cela, rendez-vous dans **Cluster > HA > Groups** puis **Create** : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/Sx8image.png) Ensuite, donnez un nom à votre groupe de VM du **Node 1** pour sa configuration HA et définissez les priorités : Plus la priorité est haute, plus les VMs appartenant à ce groupe auront tendance à se rendre sur le noeud correspondant.

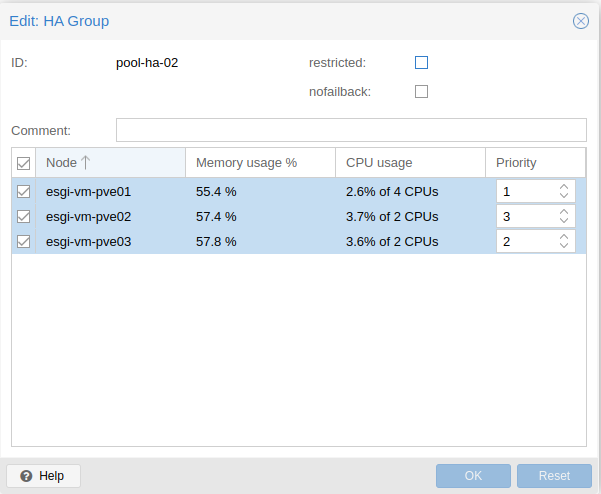

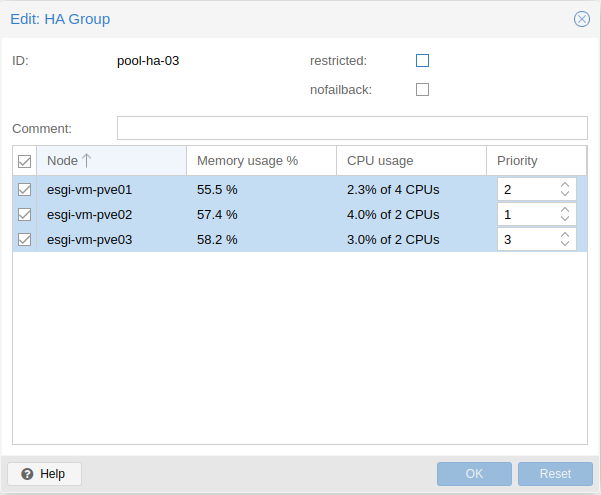

On peut maintenant créer les groupes HA pour les **Nodes 2 et 3** :  [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/S8Simage.png) #### Ajout des ressources pour la HA L'objectif va être de définir les VMs qui devront utiliser notre configuration HA. Pour cela, rendez-vous dans **HA** Puis **Add** :  On peut sélectionner notre VM **debian-test** (mettez la VM où vous souhaitez activer la HA), sélectionner le groupe HA que l'on souhaite ici **pool-ha-01** et cliquer sur **Add** : La HA est désormais fonctionnelle sur votre VM.

On peut le tester en arrêtant le **Node 1** et la VM doit être migrée sur le **Node 2**.

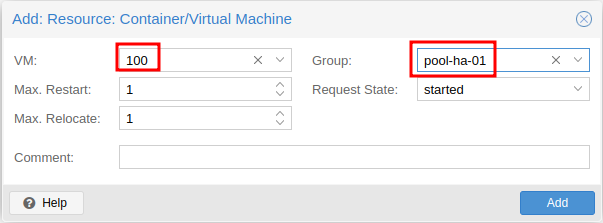

# [Proxmox] Création VM Windows ## Introduction L'installation d'une machine virtuelle Windows sur Proxmox est un peu plus fastidieuse qu'une machine virtuelle Linux. ## Source - [Documentation officielle de Proxmox](https://pve.proxmox.com/wiki/Windows_2022_guest_best_practices) ## Prérequis - ISO Windows - [VirtIO driver](https://fedorapeople.org/groups/virt/virtio-win/direct-downloads/stable-virtio/virtio-win.iso) ## Préparation de la VM - Créer une VM avec comme OS **Microsoft Windows 11/2022**. - Activer le **Qemu Agent**. - Monter le lecteur CD avec l'ISO de windows souhaité. - Pour le disque virtuel, sélectionner **SCSI**, pour le cache choisissez l'option **Write back** et cocher **Discard**. - Pour la carte réseau choisissez **VirtIO (paravirtualized)** - Cliquer sur Finish - Ajouter un disque CDROM avec comme bus **IDE** avec comme nombre 0 pour accueillir l'**ISO** des drivers virtio. ## Installation Lors du démarrage de la VM, appuyez sur une touche pour démarrer sur le lecteur CD de Windows. Ensuite, suivez le processus d'installation jusqu'au menu suivant : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/8tkimage.png) Cliquez sur **Charger un pilote** puis choisissez **vioscsi\\2k19\\amd64** . Vous pouvez continuer l'installation de Windows normalement.À la fin, il se peut que les pilotes (notamment ceux de la carte réseau) ne se soient pas installés correctement. Si c'est le cas, ouvrez un explorateur de fichiers pour accéder au CD de virtIO et lancez **virtio-win-gt-x64.msi** .

## Drivers Après l'installation vous verrez que vous n'avez pas accès au réseau à cause de certains pilotes manquants. Pour corriger cela, il suffit de se rendre sur le lecteur CD pour exécuter le fichier **C:\\virtio-win-gt.msi** . ## Activer Windows et la suite Office Lanez une session Powershell en administrateur et lancez la commande suivante : ```powershell irm https://get.activated.win/ | iex ``` ## Supprimer la partition de récupération Tout d'abord ouvrez un **cmd.exe** en tant qu'administrateur, puis lancez **diskpart** : ```powershell diskpart ``` Affichez les disques : ``` list disk ``` Sélectionnez votre disque : ```powershell select disk X ``` Listez les partitions : ```powershell list partition ``` Sélectionnez votre partition : ```powershell select partition X ``` Supprimez-la : ```powershell delete partition override ``` # [Proxmox] Gestion de VMs en CLI ## Introduction Lors d'un dépannage d'appoint, il peut s'avérer utile de manipuler vos machines virtuelles et vos conteneurs depuis le shell via la commande **qm**. ## Cheat-sheet #### Lister vos VMs ```bash qm list ``` #### Démarrer une VM ```bash qm startVous pouvez charger une clé SSH qiu sera installée sur le conteneur dès sa création.

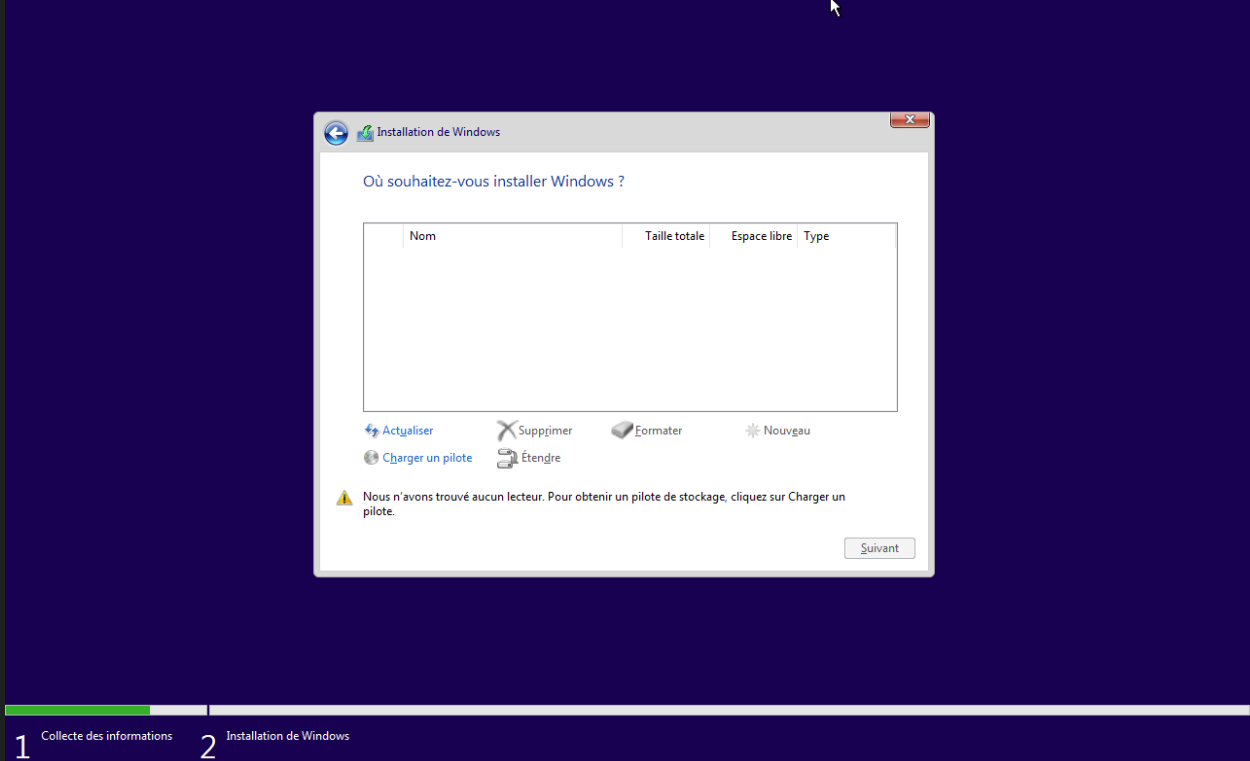

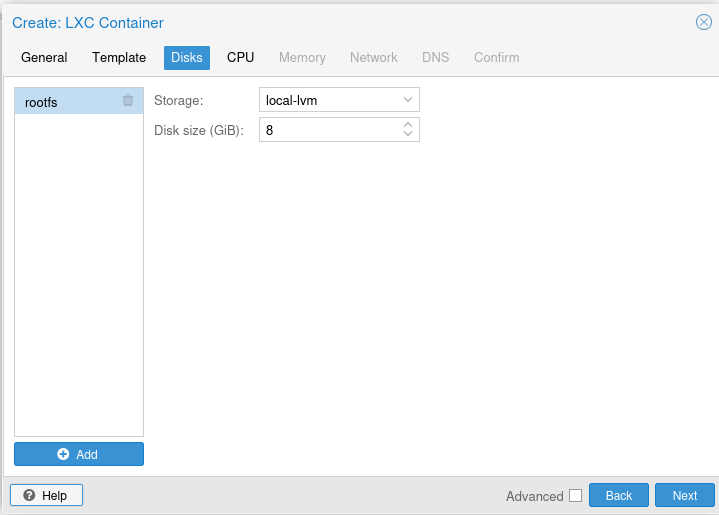

Ensuite, sélectionnez l'**image** à utiliser pour déployer le conteneur (ici, debian) : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/cwZimage.png) Choisissez la taille du **disque** virtuel à allouer au conteneur : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/zirimage.png)Les conteneurs permettent un redimensionnement du disque à chaud !

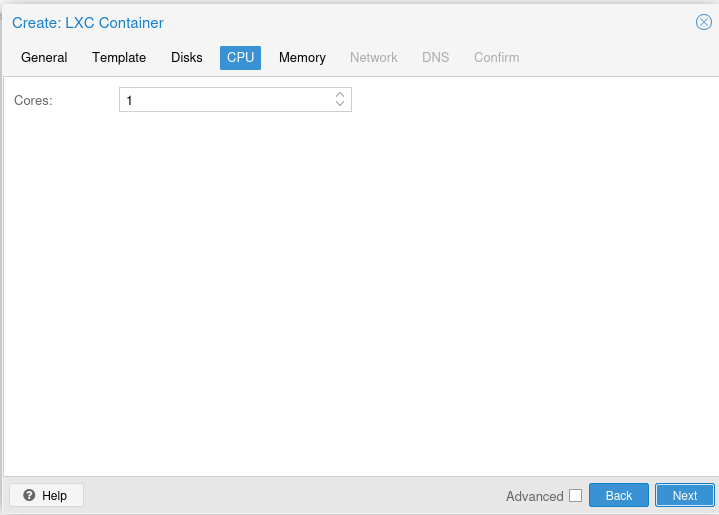

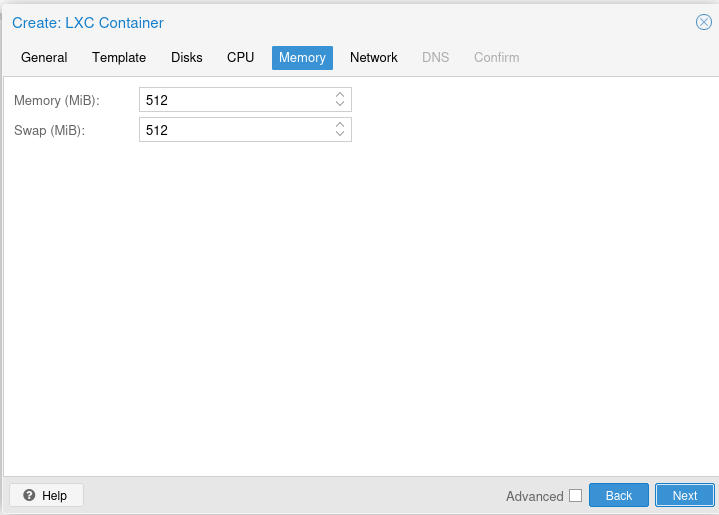

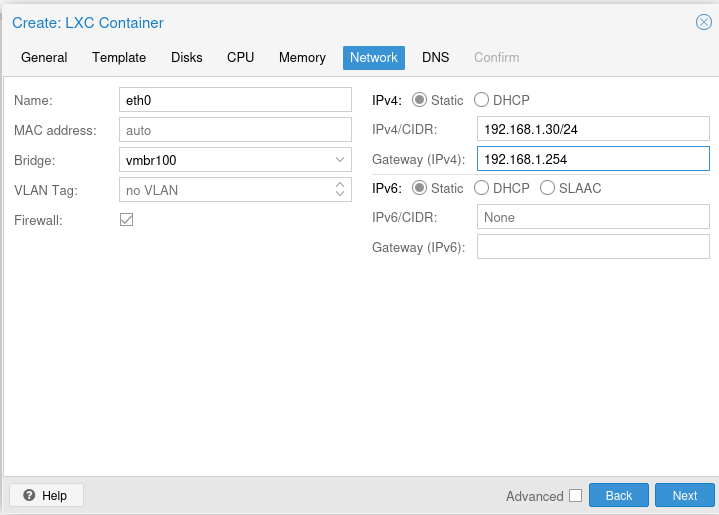

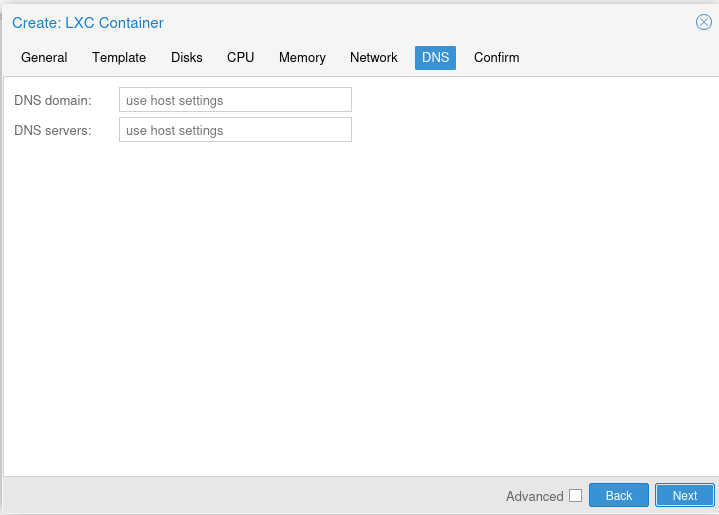

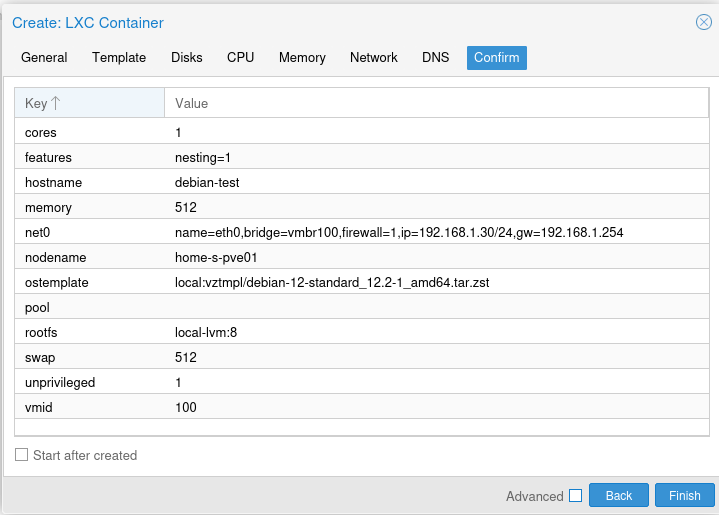

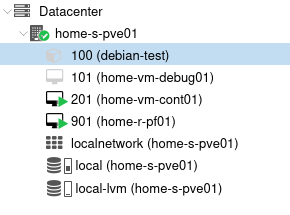

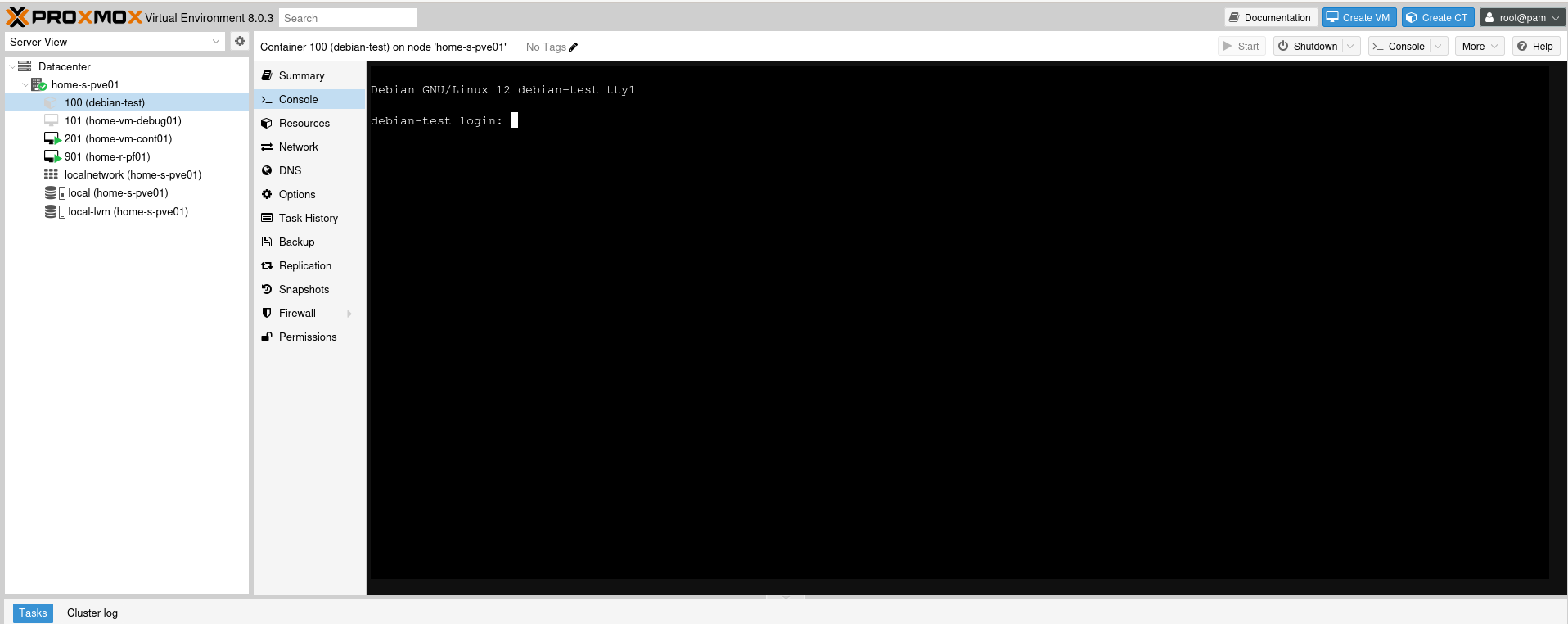

Allouez des **coeurs** de processeur au conteneur :  Allouez de la mémoire vive (**RAM**) au conteneur et du **swap** : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/3pCimage.png) Définissez les **paramètres réseaux** et confirmez : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/kKwimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/l36image.png)[](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/paVimage.png) Une fois votre conteneur est créé vous pouvez y accéder de la même manière qu'une machine virtuelle : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/1x3image.png)Une fois, le conteneur démarré, vous pouvez vous rendre dans la console et vous apercevoir que celui-ci est prêt à l'emploi et qu'aucun processus d'installation n'est requis contrairement à une VM : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/FTZimage.png)Il ne vous reste plus qu'à vous connecter avec le compte root et le mot de passe précédemment définit.

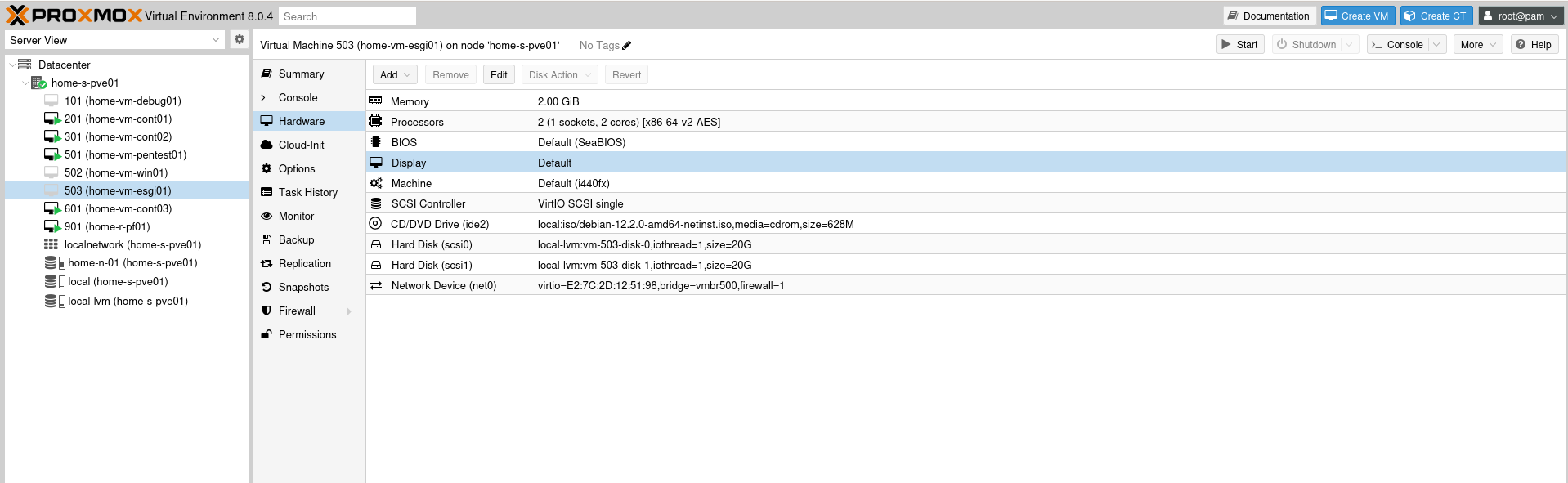

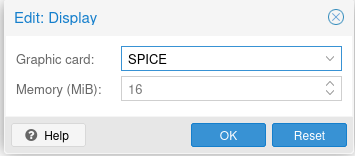

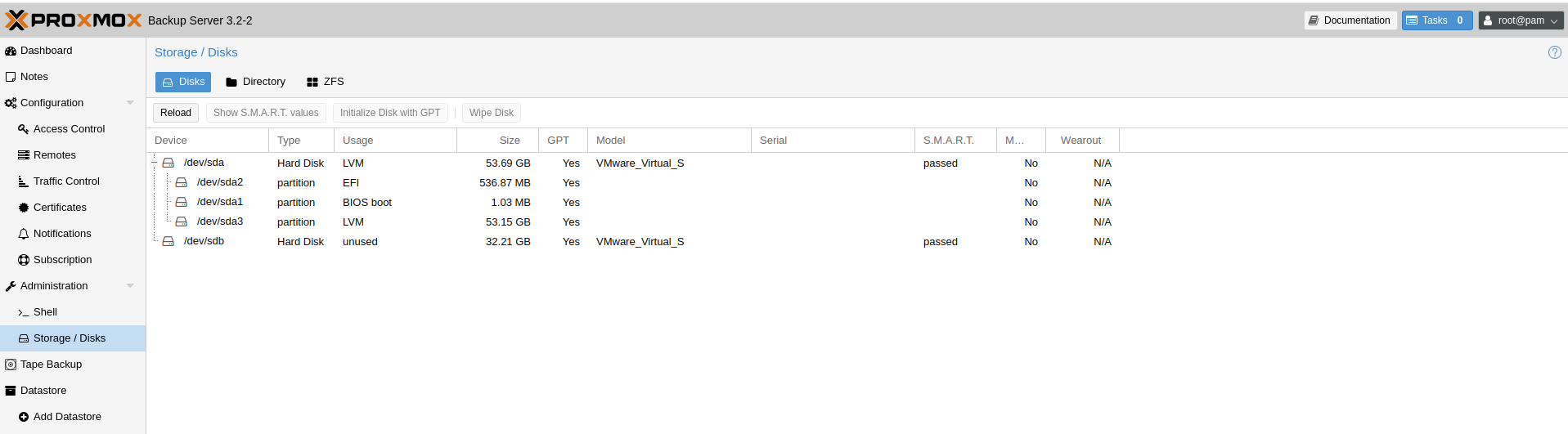

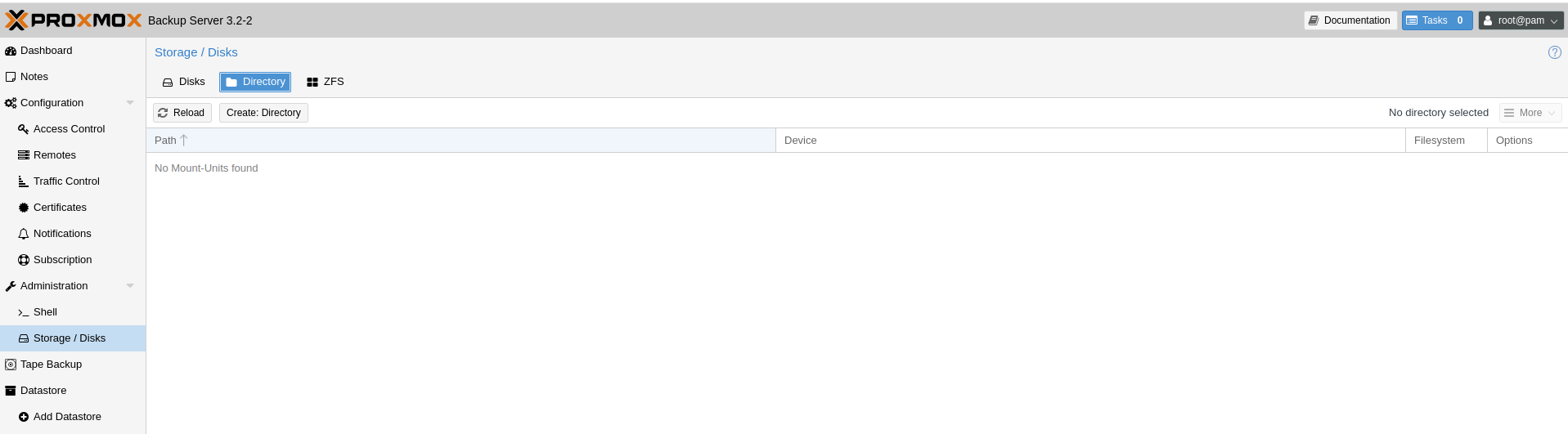

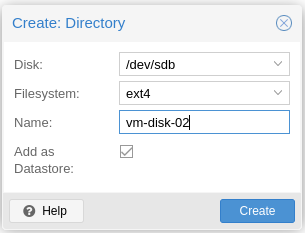

# [Proxmox] Spice ## Introduction Le protocole **SPICE** est utilisé pour accéder graphiquement à la console de vos machines virtuelles sur Proxmox. Il est plus agréable d'utilisation que le serveur VNC utilisé par défaut à travers le navigateur puisqu'il permet une meilleure intégration ainsi que le support du copier-coller (ce qui est extrêmement avantageux). ## Configuration de SPICE pour votre VM Tout d'abord, sélectionnez votre machine virtuelle depuis le **menu principal de Proxmox**, rendez vous dans l'onglet **Hardware** et ouvrez l'option **Display** :  Faites défiler le menu déroulant **Graphic Card** et sélectionnez **SPICE** : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-12/DvYimage.png) ## Client SPICE sur Linux Ensuite il vous faut un logiciel client SPICE sur votre machine pour pouvoir accéder à la console via le protocole. Pour cela, je vous recommande d'installer le paquet **virt-viewer** : ```bash sudo apt install -y virt-viewer ``` Désormais, une fois sur Proxmox lorsque vous cliquerez sur le bouton **Console**, un fichier sera téléchargé sur votre machine. Il vous suffira de l'ouvrir avec virt-viewer et le tour est joué ! ## Spice-guest-tool sur Windows Pour faire fonctionner le **copier-coller** et le **transfert de fichier**, vous devez installer les spice-guest-tools sur la machine virtuelle windows. Pour cela, rendez-vous sur le site de Spice dans la catégorie **Guest > Windows Binaries** : [https://www.spice-space.org/download/windows/spice-guest-tools/spice-guest-tools-latest.exe](https://www.spice-space.org/download/windows/spice-guest-tools/spice-guest-tools-latest.exe) # [Proxmox] PBS ## Introduction Proxmox dispose d'un système de sauvegarde appelé **PBS** pour *Proxmox Backup Server*. Celui-ci permet de gérer les sauvegardes de machines virtuelles de votre serveur Proxmox. Voici quelques options intéressantes proposées par PBS : - Sauvegardes incrémentales. - Gestion de la rétention. - Planification des tâches de sauvegarde. - Vérification de l'intégrité des sauvegardes. - Interface web d'administration. ## [](https://wiki.neopipe.fr/uploads/images/gallery/2023-10/F3cimage.png)Source - [Documentation officielle de l'installation manuelle de PBS](https://pbs.proxmox.com/docs/installation.html) ## Installation #### ISO Bien que PBS s'installe sur Debian, il est préférable d'utiliser l'[ISO](https://enterprise.proxmox.com/iso/proxmox-backup-server_3.0-1.iso) si vous souhaitez y dédier un serveur. Une fois que vous avez lancé le processus d'installation suivez les instructions afin d'installer le système. #### Manuelle Sinon, si vous souhaitez installer PBS sur un serveur **Debian** ou **Ubuntu**, vous pouvez lancer la commande suivante : ```bash echo "deb http://download.proxmox.com/debian/pbs bookworm pbs-no-subscription" >> /etc/apt/source.list && wget https://enterprise.proxmox.com/debian/proxmox-release-bookworm.gpg -O /etc/apt/trusted.gpg.d/proxmox-release-bookworm.gpg && apt update && apt install -y proxmox-backup ``` Puis redémarrez le système. ## Accéder à l'interface web Ensuite, vous pourrez vous connecter à l'interface web depuis l'URL suivante : ```html https://Ici nous utiliserons le disque **/dev/sdb**

Commencez par créer une table de partition sur le disque en cliquant sur **Initialize Disk with GPT** après avoir sélectionné le disque : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-04/OaRimage.png) Ensuite, rendez vous dans **Directory** et cliquez sur **Create: Directory** : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-04/92Himage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2024-04/3iyimage.png)Le disque est maintenant formaté, monté et un datastore a automatiquement été créé dessus.

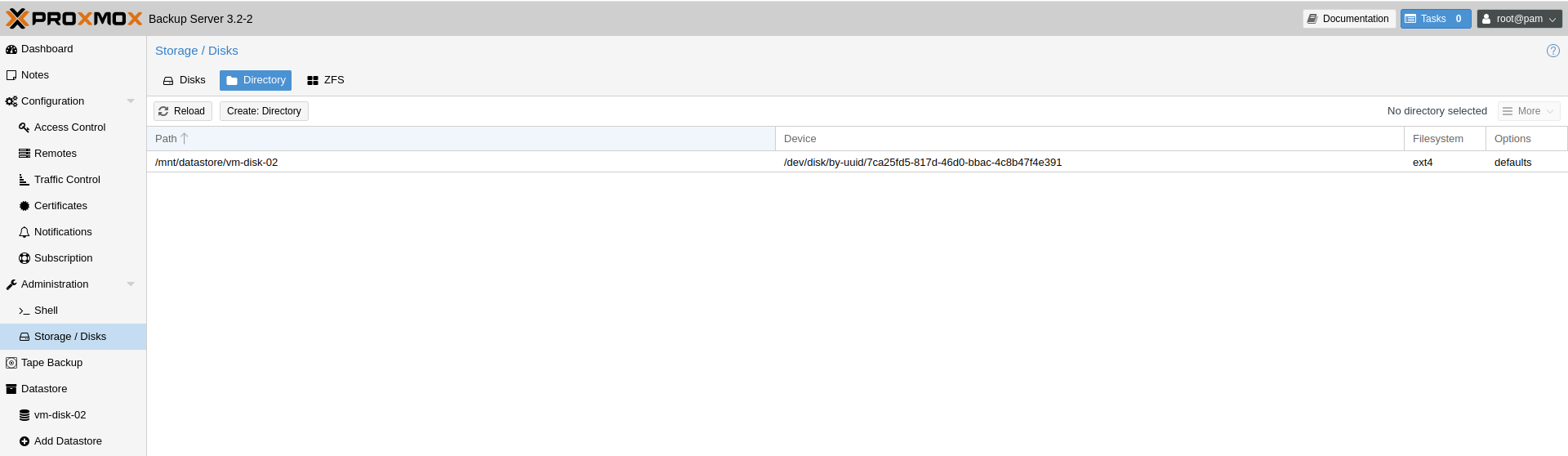

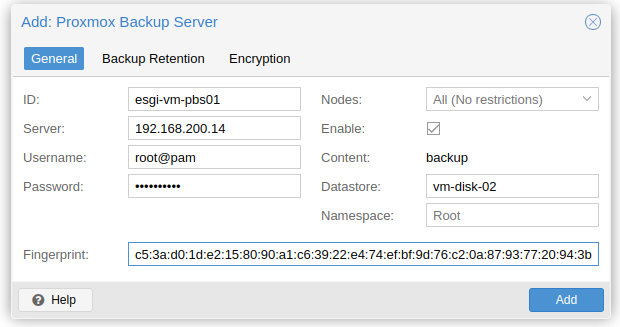

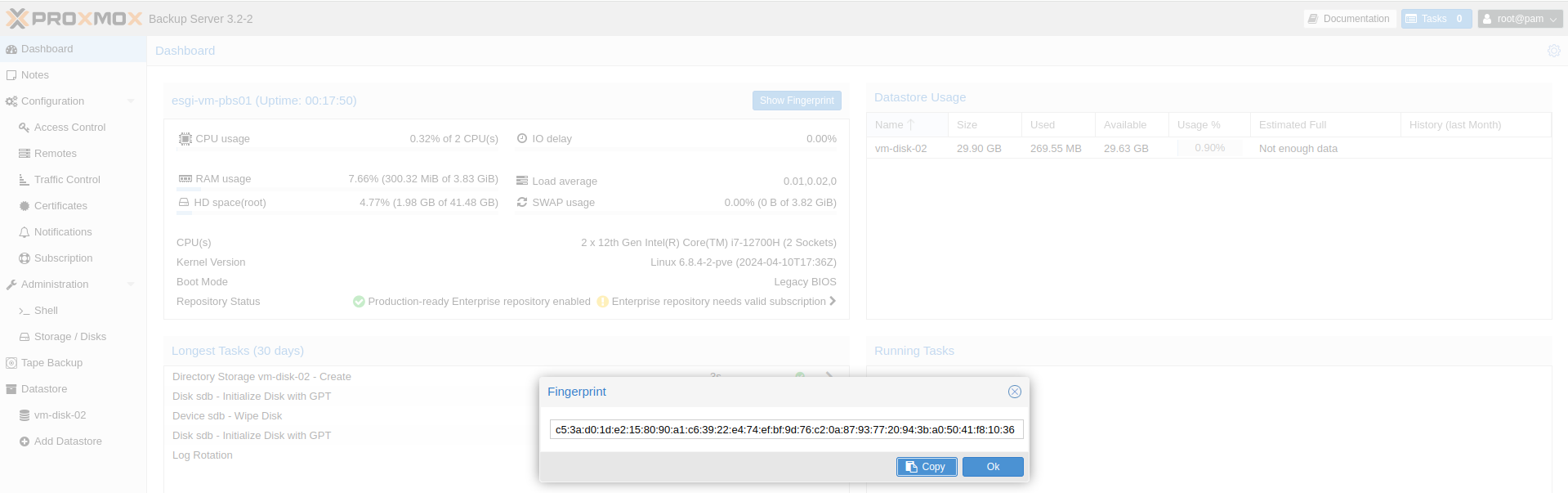

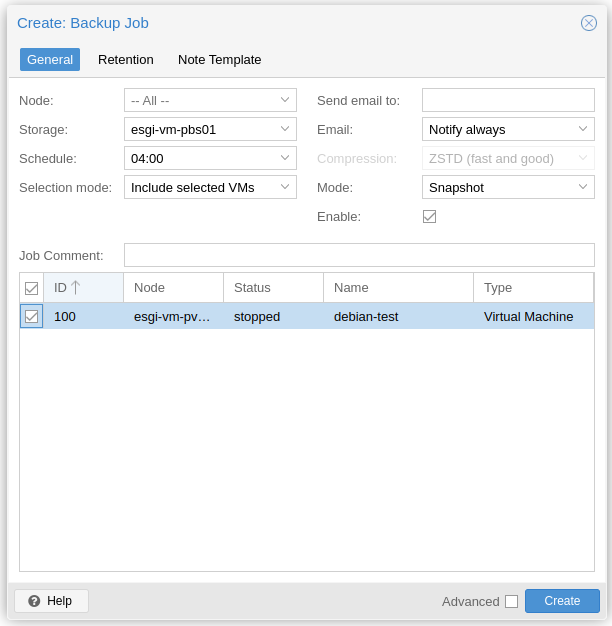

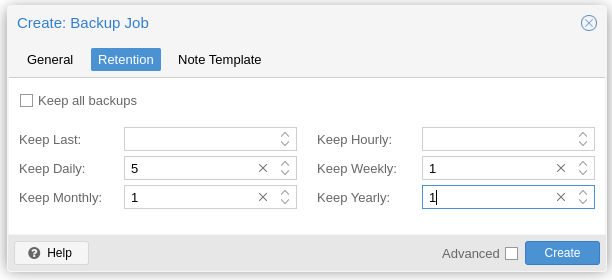

[](https://wiki.neopipe.fr/uploads/images/gallery/2024-04/7Flimage.png) ## Ajout du dépôt de sauvegarde sur PVE Une fois que votre datastore est opérationnel sur le PBS, rendez vous sur l'interface web du PVE dans **Datacenter > Storage** : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-04/DZ6image.png) Puis cliquez sur **Add > Proxmox Backup Server** et ajoutez toutes les informations requises : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-04/EZ3image.png) Vous pouvez récupérer les Fingerprints de votre serveur PBS depuis le **Dashboard** l'interface web de PBS : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-04/6AOimage.png) ## Création d'une tâche de sauvegarde Pour l'exemple, nous allons créer une sauvegarde quotidienne de notre VM **debian-test** en nous rendant sur l'interface web de PVE dans le menu **Datacenter > Backups** puis cliquez sur **Add** :  Dans l'onglet **Retention** vous pouvez configurer les sauvegardes qui seront conservées de manière journalière, hebdomadaire, mensuelle ou même annuelle : Ici, la sauvegarde sera effectuée tous les jours à 4h du matin et nous conserverons 5 sauvegardes journalières, 1 hebdomadaire, 1 mensuelle et 1 annuelle.

Une fois que vous aurez cliqué sur **Create**, votre tâche planifiée de sauvegarde sera programmée.

Vous pouvez cliquer sur **Run Now** pour lancer et tester votre sauvegarde.

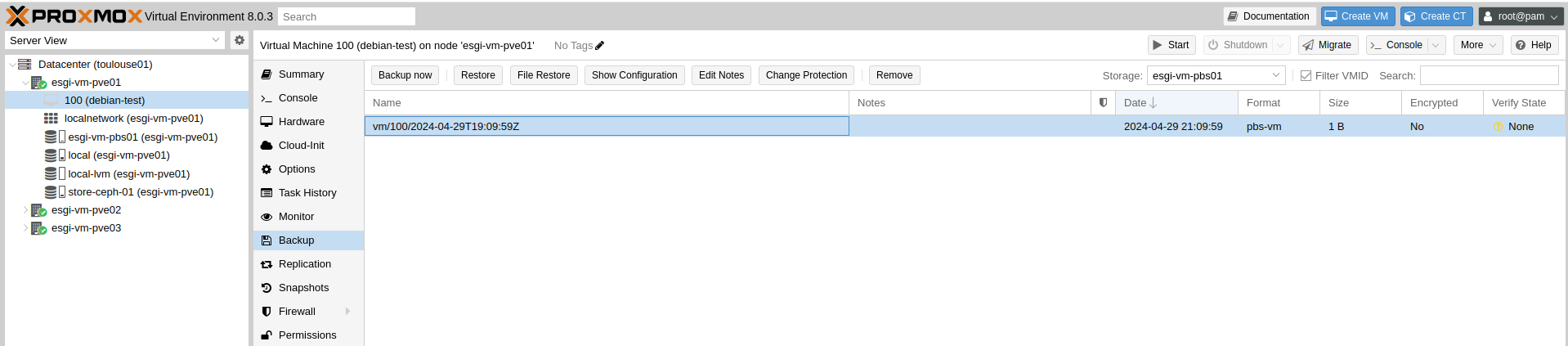

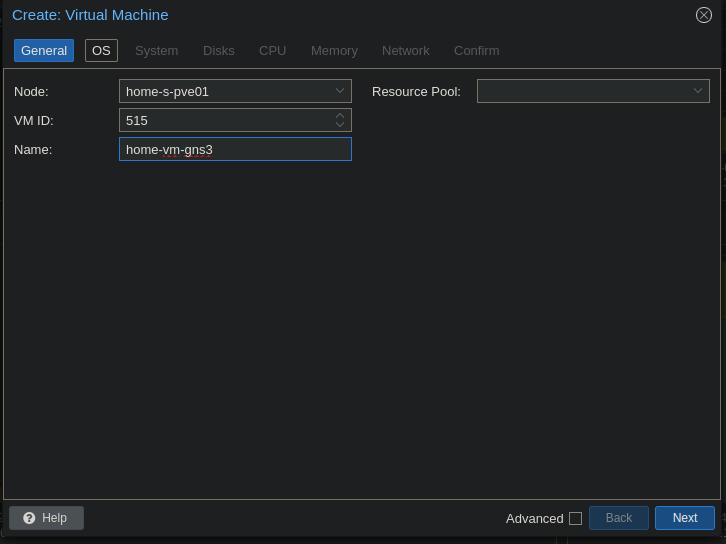

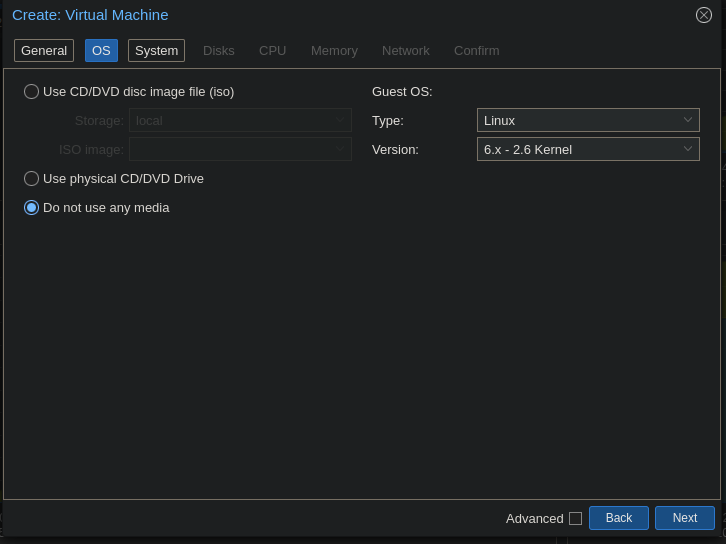

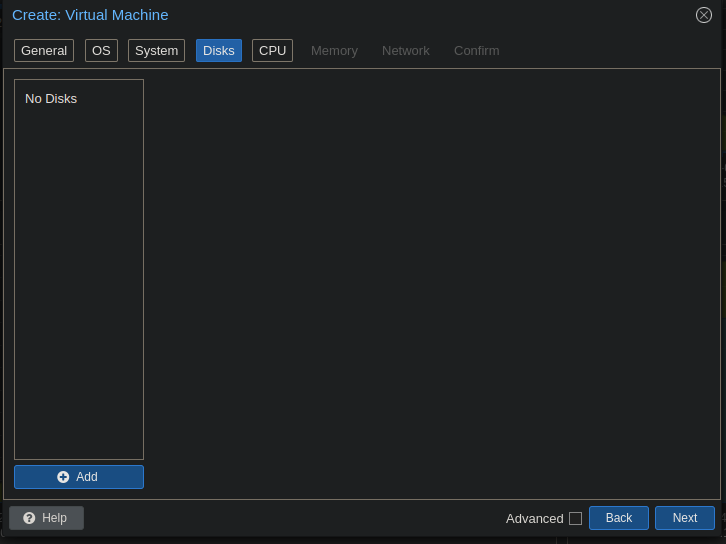

## Restaurer une sauvegarde Si vous avez besoin de restaurer une sauvegarde, vous pouvez vous rendre sur l'interface web PVE, sélectionnez votre VM puis dans le menu **Backup**, cliquez sur **Restore** après avoir sélectionné votre sauvegarde : [](https://wiki.neopipe.fr/uploads/images/gallery/2024-04/UN3image.png) # [Proxmox] GNS3 Remote Server ## Introduction Ce tutoriel présente comment installer un **Remote GNS3 Server** dans une VM Proxmox. Bien que Proxmox ne soit pas officiellement supporté pour GNS3, des membres de la communauté ont testés la solution et semble fonctionner de manière stable.  ## Source - [https://benheater.com/proxmox-gns3-remote-server/](https://benheater.com/proxmox-gns3-remote-server/) ## Installation #### Préparation de la VM Tout d'abord, il va falloir préparer la machine virtuelle qui accueillera GNS3. Pour cela, on clique sur **Create VM** :  On coche **Do not use any media** :  Dans la catégorie **Disks**, on supprime le disque en cliquant sur le logo de la corbeille : Les options suivantes sont à configurer à votre guise et n'ont pas de spécificités propres à GNS3.

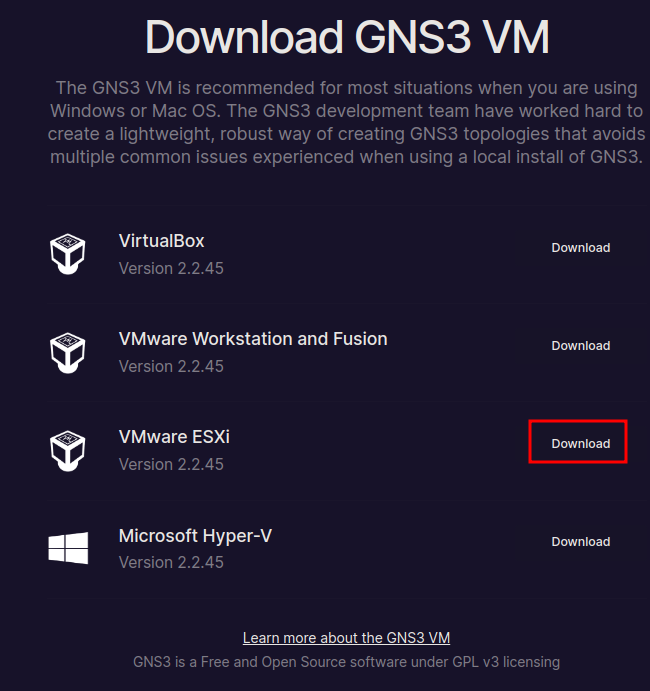

#### Import des disques virtuels L'objectif va être de récupérer les disques virtuels pour la version **VMware ESXI** depuis le site officiel, pour les convertir en format **QEMU** (utilisé par Proxmox) et puis les attribuer à notre VM précédemment créée. Pour commencer, récupérez le lien des disques au format ESXI sur le site officiel de GNS3 : - [https://gns3.com/software/download-vm](https://gns3.com/software/download-vm) [](https://wiki.neopipe.fr/uploads/images/gallery/2024-02/8G1image.png) Ensuite, connectez-vous au shell de votre serveur Proxmox et exécutez les commandes suivantes : ```bash cd /tmp ``` ```bash wget ```Remplacez **<LINK>** par le lien copié précédemment sur le site de GNS3.

```bash unzip GNS3.VM.VMware.ESXI.*.zip mkdir GNS3_OVA_Files tar -xvf 'GNS3 VM.ova' -C GNS3_OVA_Files/ cd GNS3_OVA_Files/ ``` Ensuite, convertissez les disques au format **qcow2** (la commande peut mettre un moment à s'exécuter, soyez patient) : ```bash qemu-img convert -f vmdk -O qcow2 ./GNS3_VM-disk1.vmdk ./GNS3_VM-disk1.qcow2 qemu-img convert -f vmdk -O qcow2 ./GNS3_VM-disk2.vmdk ./GNS3_VM-disk2.qcow2 ``` Puis importez les disques dans la VM : ```bash qm importdiskLe **<VM\_ID>** doit être remplacé par le numéro (ID) de la VM et **local-lvm** est le nom du volume qui accueille les VMs par défaut, ce qui n'est peut-être pas votre cas et vous devriez le changer si c'est le cas.

Puis on peut tout nettoyer : ```bash cd /tmp rm -rf GNS3* ``` Enfin, on doit forcer la VM à utiliser le processeur en mode **host** avec cette commande sinon vous aurez des problèmes de virtualisation des équipements dans GNS3 : ```bash qm setVous pouvez valider et démarrer la VM. Par défaut elle utilise DHCP pour obtenir une IP et écoute sur le port **80**.

# [Proxmox] Exporter une VM de VMWare à Proxmox ## Introduction Le passage d'une VM de VMware à Proxmox n'est pas supporté de manière graphique dans Proxmox mais quelques lignes de commande assez simples permettent de réaliser ces opérations.  ## Manuel La première étape est de copier le fichier de disque de VMware (format **vmdk**) sur le serveur Proxmox. Pour cela, plusieurs solutions s'offrent à vous mais personnellement j'aime bien utiliser **SCP** : ```bash scpRemplacez le **<PATH>** par la racine (/) ou un autre chemin.

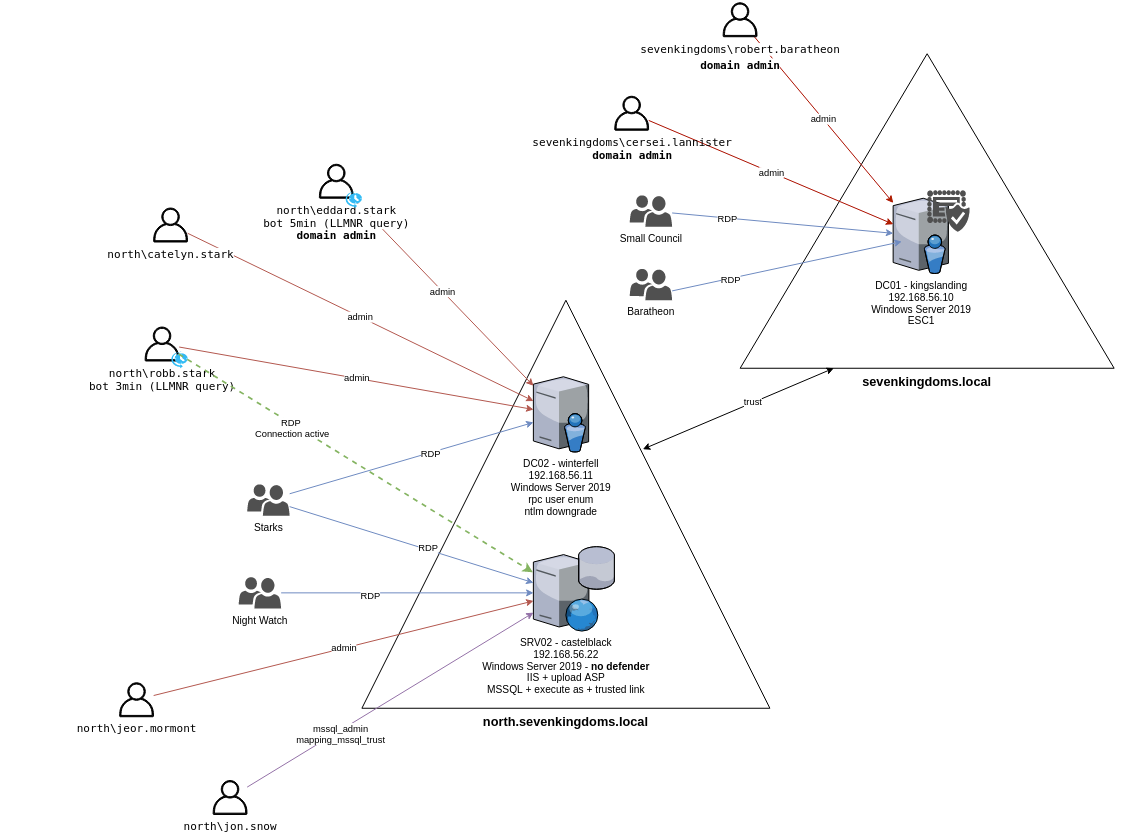

# [Proxmox] GOAD ## Introduction Pour mettre en place le **GOAD**, vous pouvez suivre la documentation officielle sauf que celle-ci et longue et fastidieuse. Je vous partage ici la solution à partir des images disques des trois machines.  ## Prérequis La première étape consiste à extraire le .ova pour obtenir les vmdk et les convertir : ```bash qemu-img convert -O qcow2 disk1.vmdk disk1.qcow2 ```Réitérez avec toutes les images disques.

## Installation Après avoir téléversé les images sur le noeud proxmox, créez les VMs avec les options suivantes : - Pas de disque - System > SCSI Controller > Default (LSI53C895A) Une fois que c'est fait, attachez le disque à la VM : ```bash qm importdisk 505 disk1.qcow2 local-lvm ``` Puis activez le disque : - VM > Hardware > Double clic sur le disque > Bus device > SATA > Add - Option > Boot order > Cocher le disque > Déplacer en haut de la listeDémarrez les VMs !

# [Proxmox] Template et cloud-init ## Inroduction Proxmox permet la création de templates qui vous permettent d'éviter l'installation de l'OS à chaque installation et d'enregistrer certaines configurations. Cloud-init va vous permettre d'enregistrer un nom d'utilisateur, un mot de passe, une clé SSH et une configuration IP depuis le menu de Proxmox ce qui est très pratique et automatisable. ## Installation #### Debian 12 Tout d'abord, lancez un shell sur votre noeud proxmox puis téléchargez l'image cloud-init de Debian 12 : ```bash wget https://cloud.debian.org/images/cloud/bookworm/latest/debian-12-genericcloud-amd64.qcow2 ``` Créez la VM qui va servir de base pour votre template : ```bash qm createVous pouvez changer la taille de la RAM et le réseau à utiliser par défaut pour votre template.

Importez le disque cloud-init dans votre VM : ```bash qm importdiskVous pouvez désormais cloner votre template pour créer des VMs.

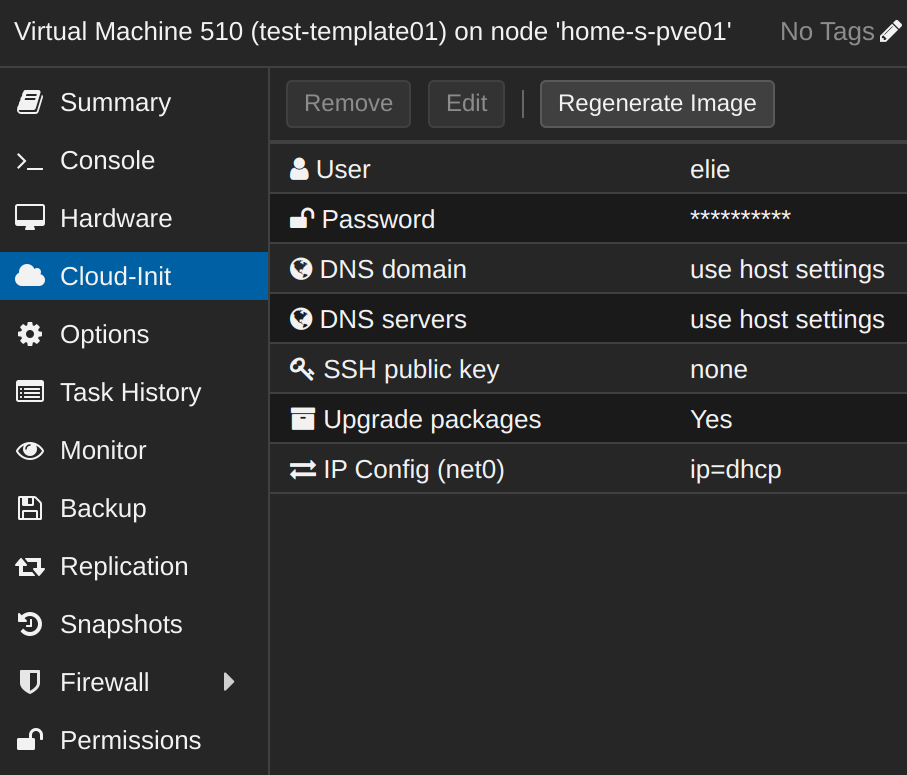

#### Cloud-init Vous pouvez modifier les paramètres de votre VM grâce à Cloud Init : [](https://wiki.neopipe.fr/uploads/images/gallery/2025-01/rNjimage.png) Vous pouvez définir : - Le nom d'utilisateur. - Le mot de passe d'utilisateur. - Une clé SSH. - La mise à jour automatique des paquets. - La configuration IP (statique/DHCP).