Le raid devrait se reconstruire sans perte de données !

#### Supprimer un raid Tout d'abord, il faut penser à démonter le raid (s'il est monté) : ```bash umount /dev/md0 ``` Ensuite on peut éteindre le raid : ```bash mdadm --stop /dev/md0 ``` Et on supprime l'entrée (la ligne) du raid dans le **/etc/fstab** : ```bash nano /etc/fstab ``` # [Debian] Serveur DNS ## Introduction Un serveur DNS permet la résolution de noms de domaine en adresse IP et inversement sur un réseau. Dans ce tutoriel nous utiliserons la solution **Bind9** sur une Debian 11 ayant comme adresse IP 10.100.0.86. Le domaine configuré sera **elie.local**. [](https://wiki.neopipe.fr/uploads/images/gallery/2023-09/01Eimage.png) ## Installation - Installez le paquet bind : ```bash apt update && apt install -y bind9 ``` - Au cas où un fichier vous souhaiteriez restaurer les fichiers de configuration par défaut, je vous recommande de faire une sauvegarde de ces différents fichiers : ```bash cp /etc/bind/named.conf /etc/bind/named.conf.bak ``` ```bash cp /etc/bind/named.conf.options /etc/bind/named.conf.options.bak ``` ```bash cp /etc/bind/named.conf.local /etc/bind/named.conf.local.bak ``` ## Configuration de forwarding - Éditez le fichier **/etc/bind/named.conf.options** de sorte à obtenir cette configuration (à adapter) : ```bash options{ directory "/var/cache/bind"; recursion yes; allow-query { 10.100.0.0/24; 127.0.0.1; }; forwarders { 1.1.1.1; 8.8.8.8; }; forward only; dnssec-validation auto; auth-nxdomain no; listen-on-v6 { any; }; }; ```Vous pouvez choisir les DNS primaires et secondaires vers lesquels la redirection va se produire dans les **forwarders**, ici j'utilise celui de Cloudflare en primaire et celui de Google en secondaire.

#### Vérifier les configurations Vous pouvez vérifier la configuration à l'aide de la commande suivante : ```bash named-checkconf ``` #### Redémarrer le service DNS Une fois que vous avez vérifié que votre configuration DNS est bonne, vous pouvez redémarrer le service named pour prendre en compte les changements : ```bash systemctl restart named ``` ## Configuration de zone (classique) - Éditez le fichier **/etc/bind/named.conf.local** pour configurer la zone DNS et ajoutez-y ce contenu (à adapter) : ```bash // Configuration DNS zone "elie.local" IN { type master; file "db.elie.local"; allow-update { none; }; }; // Configuration Reverse DNS sur un réseau 10.100.0.X zone "0.100.10.in-addr.arpa" IN { type master; file "rev.elie.local"; allow-update { none; }; }; ``` #### Ajout des entrées DNS À chaque fois que vous voudrez ajouter une entrée DNS, il faudra écrire l'entrée le fichier de configuration DNS et dans le fichier de configuration du reverse DNS. - Pour commencer, déplacez-vous dans le répertoire **/var/cache/bind/** et créez votre fichier de configuration des enrtées DNS, ici c'est le fichier **db.elie.local** et ajoutez le contenu suivant (à adapter) : ```bash $TTL 86400 @ IN SOA debian-dns.elie.local. root.elie.local. ( 2022111401 1w 1d 4w 1w ) @ IN NS debian-dns.elie.local. debian-dns IN A 10.100.0.86 ; SET DNS RECORDS mail IN A 10.100.0.200 debian-client-1 IN A 10.100.0.201 ``` Ici, le serveur DNS ayant pour adresse IP **10.100.0.86** aura le nom **debian-dns.elie.local** qui est enregistré comme entrée de type A. On peut voir en dessous qu'un serveur de messagerie et un poste client sont aussi enregistrés dans la base sous leurs noms respectifs (à vous de mettre vos propres entrées). - Ensuite, toujours dans le répertoire **/var/cache/bind/** il faut créer le fichier de configuration du reverse DNS, ici **rev.elie.local** : ```bash $TTL 86400 @ IN SOA debian-dns.elie.local. root.elie.local. ( 2022111401 1w 1d 4w 1w ) @ IN NS debian-dns.elie.local. 86 IN PTR debian-dns.elie.local ; SET DNS RECORDS 200 IN PTR mail.elie.local 201 IN PTR debian-client-1.elie.local ``` On s'aperçoit que le contenu est similaire à la configuration du DNS avec un différence majeure au niveau des entrées DNS qui sont de type PTR et où on indique la valeur du dernier octet de l'adresse IP pointant vers le nom correspondant. Par exemple on reconnait l'entrée du serveur de messagerie "***200 IN PTR mail.elie.local***" où **200** correspond au dernier octet de son adresse c'est à dire 10.100.0.**200**. #### Modification des droits des fichiers Afin que Bind puisse exploiter vos fichiers de configuration, les bons droits doivent être mis dessus : ```bash chgrp bind /var/cache/bind/* ``` ```bash chmod 664 /var/cache/bind/* ``` #### Modification de /etc/resolv.conf Il faut indiquer au serveur que le serveur DNS correspond désormais à lui-même dans le fichier **/etc/resolv.conf** : ```bash echo "nameserver 10.100.0.86" > /etc/resolv.conf ``` #### Vérifier les configurations Voici les deux commandes "magiques" qui permettent de vérifier que les configurations sont correctes : ```bash named-checkconf ``` L'option -z permet d'être beaucoup plus verbeux quant aux erreurs que vous pouvez rencontrer : ```bash named-checkconf -z ``` #### Redémarrer le service DNS Une fois que vous avez vérifié que votre configuration DNS est bonne, vous pouvez redémarrer le service named pour prendre en compte les changements : ```bash systemctl restart named ``` ## Configuration de vues (avancé) Cette approche est particulière puisque contrairement à la configuration en mode zone, nous pourrons définir des entrées et des traitements différents selon **l'interface** par laquelle la requête DNS va entrer. Le domaine sera toujours **elie.local** . Pour cet exemple nous aurons un lab avec 2 réseaux :| **Réseaux** | **Adresse réseau** |

| LAN | 192.168.0.0/24 |

| DMZ | 10.0.0.0/24 |

| **Machine** | **Adresse interface LAN** | **Adresse interface DMZ** | **Rôle** |

| vm-deb01 | 192.168.0.253 | 10.0.0.253 | Serveur DNS |

| vm-deb02 | 192.168.0.1 | / | Client LAN |

| vm-deb03 | / | 10.0.0.1 | Serveur web |

Cette configuration autorise un utilisateur **admin** (qui a les droits d'écriture) ainsi que les utilisateurs du groupe **LECTEURS** qui ont seulement les droits de lecture sur le partage). Vous pouvez bien sûr modifier cette configuration à souhait.

D'ailleurs, pensez à vérifier que l'utilisateur est bien propriétaire du dossier du partage. Définissez un mot de passe samba à votre utilisateur : ```bash smbpasswd -aOn notera qu'il reste un peu d'espace sur le deuxième disque qui représente l'espace qui a été utilisé sur le premier disque par la partition de démarrage.

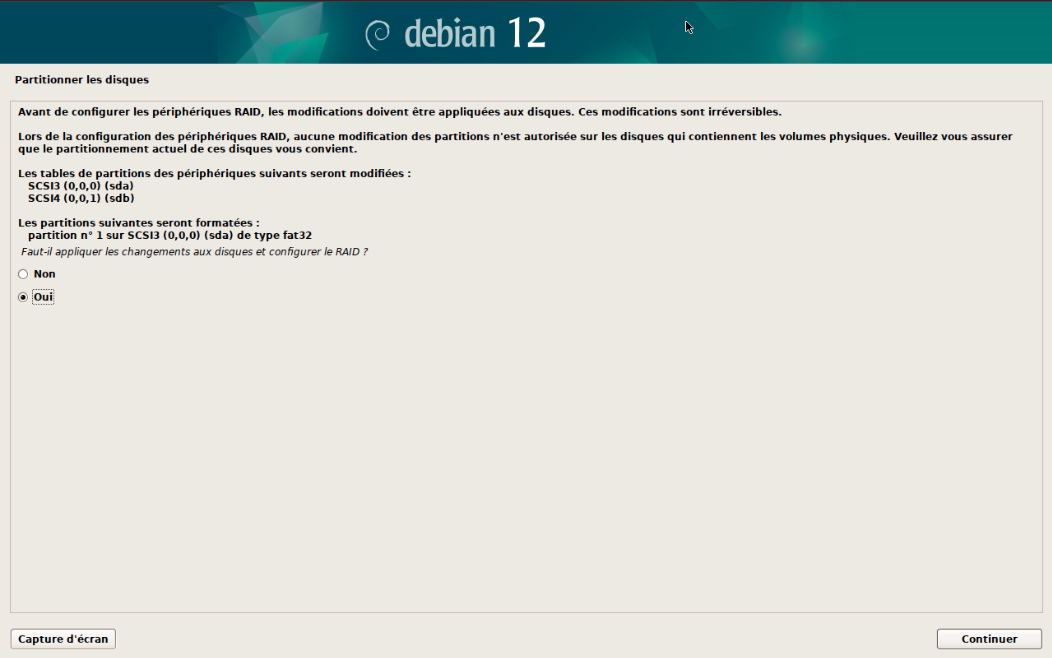

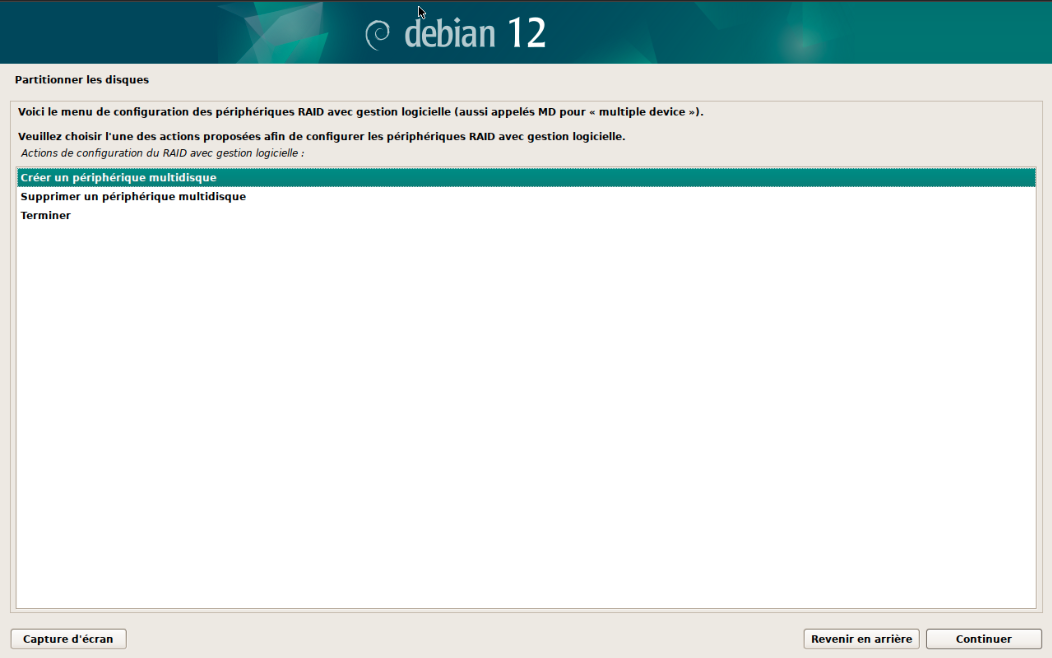

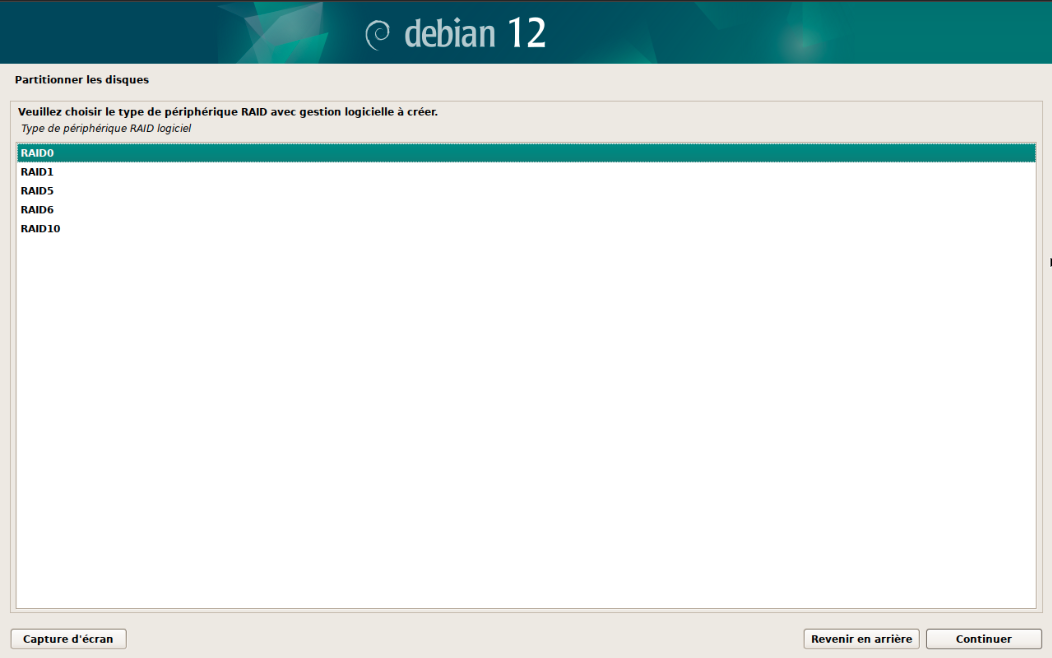

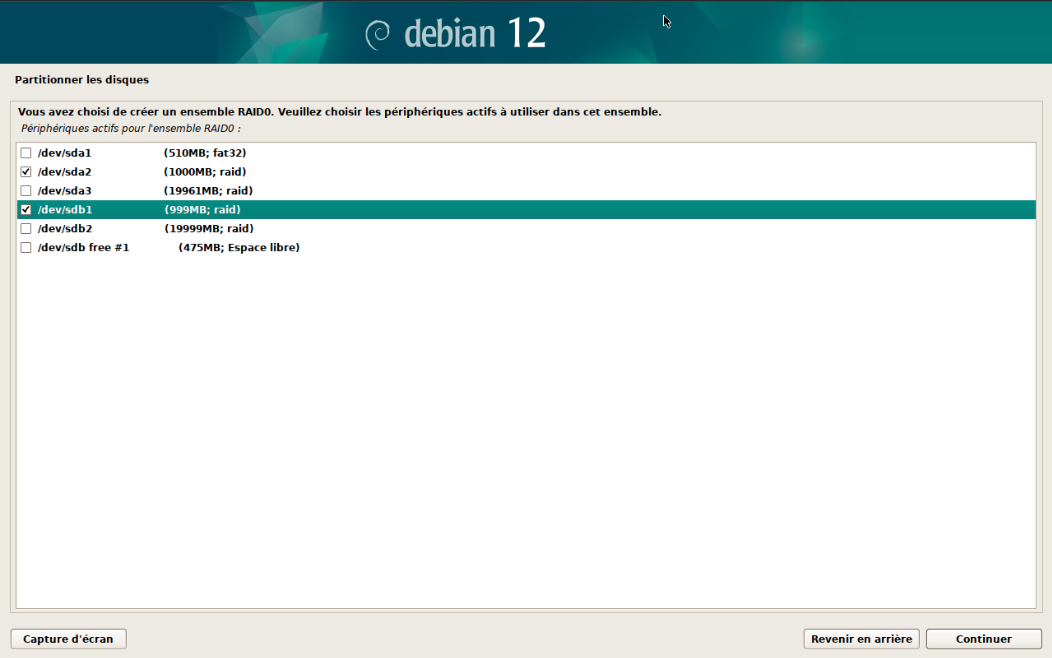

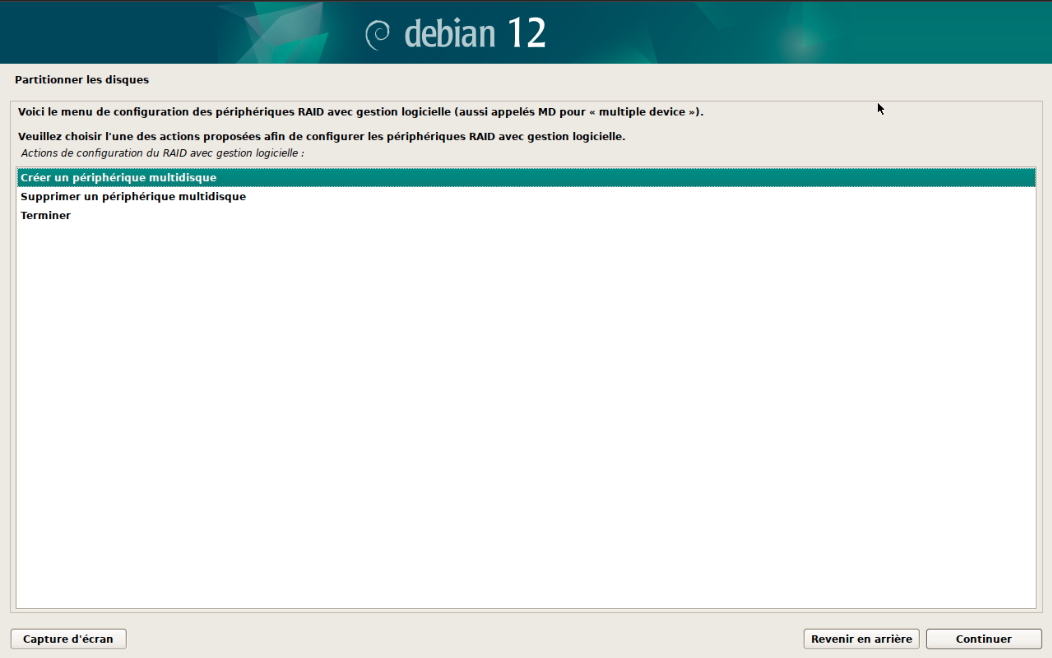

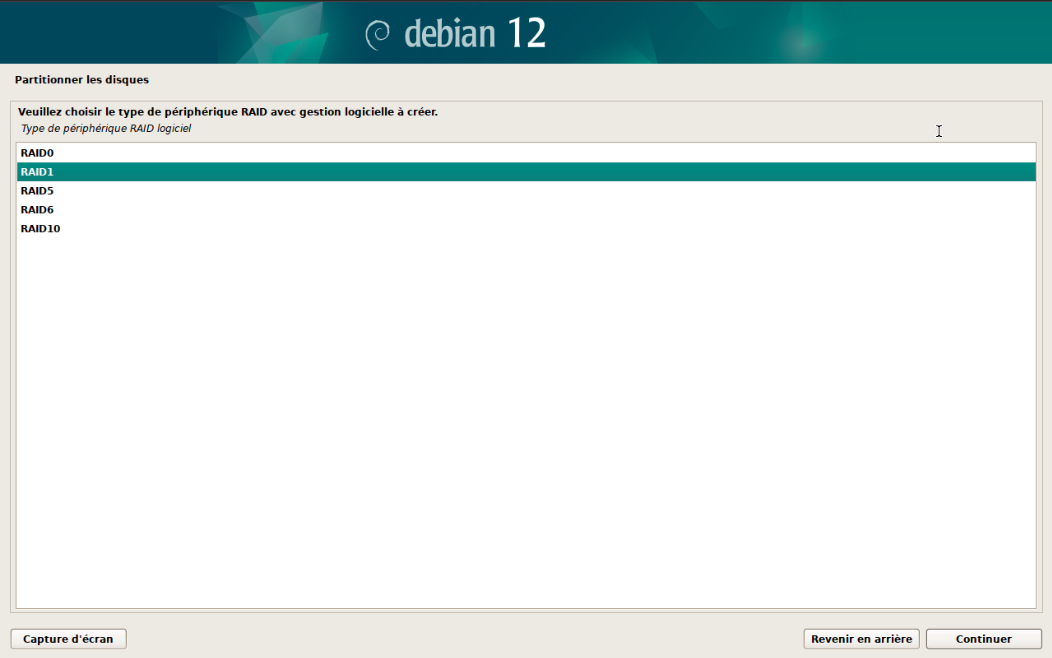

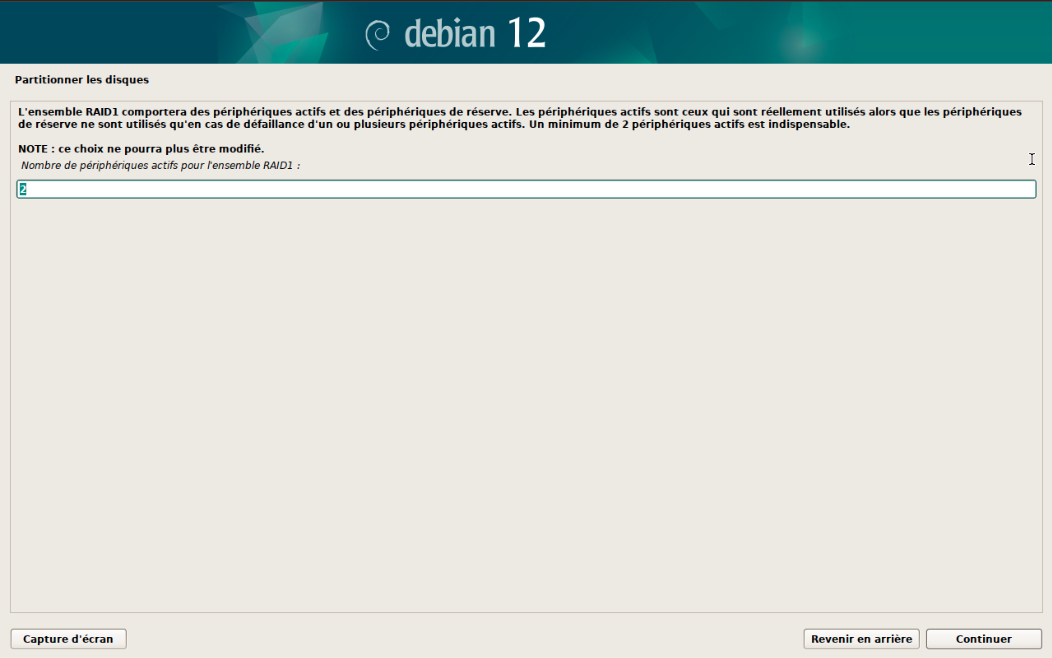

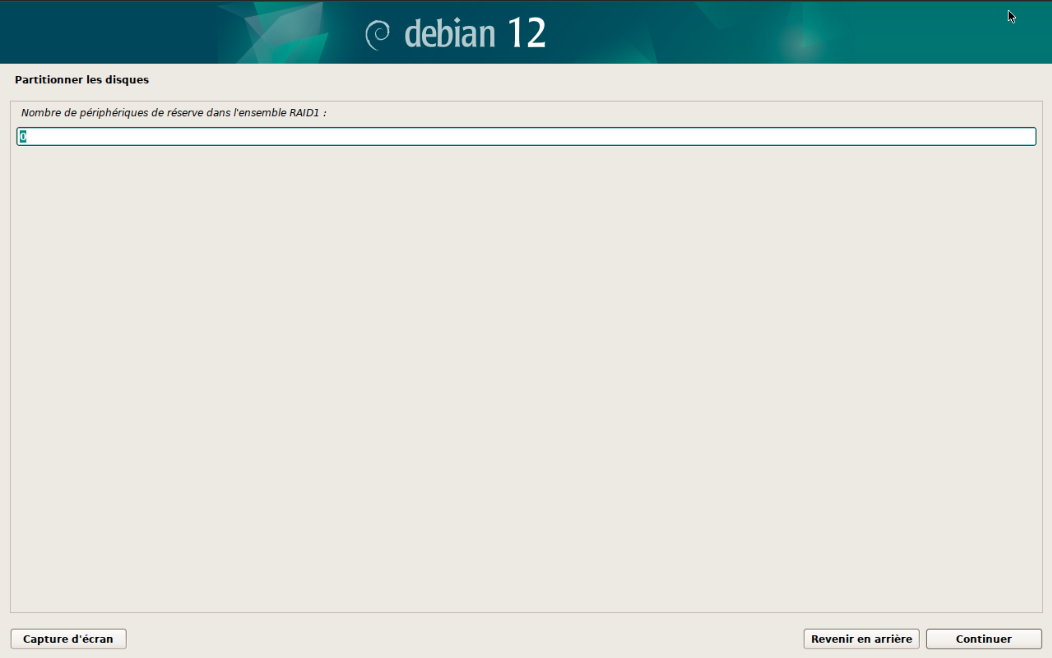

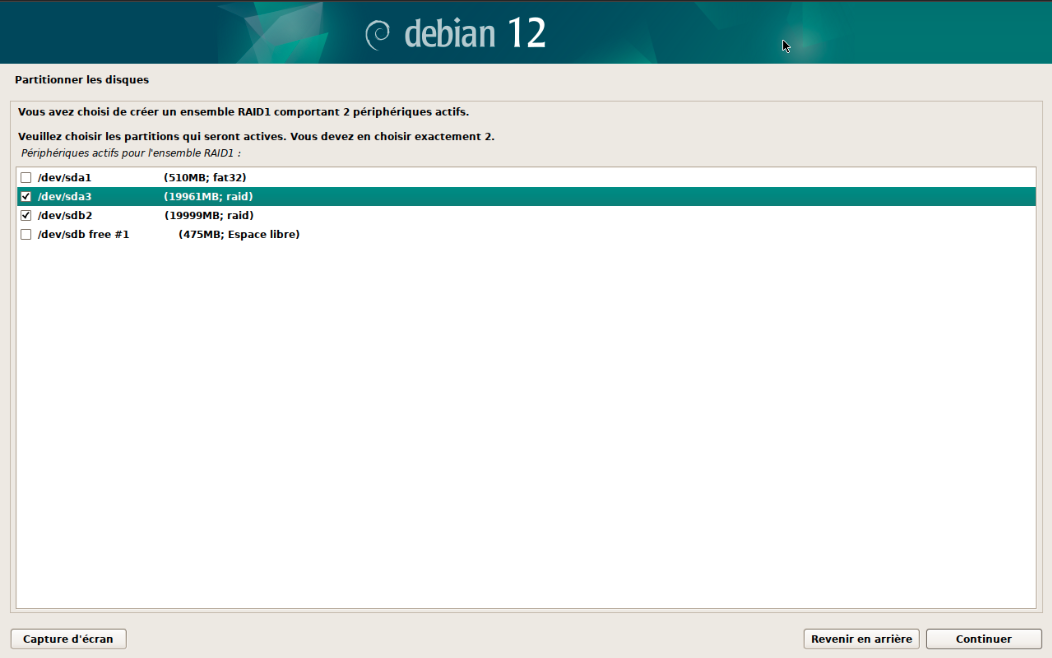

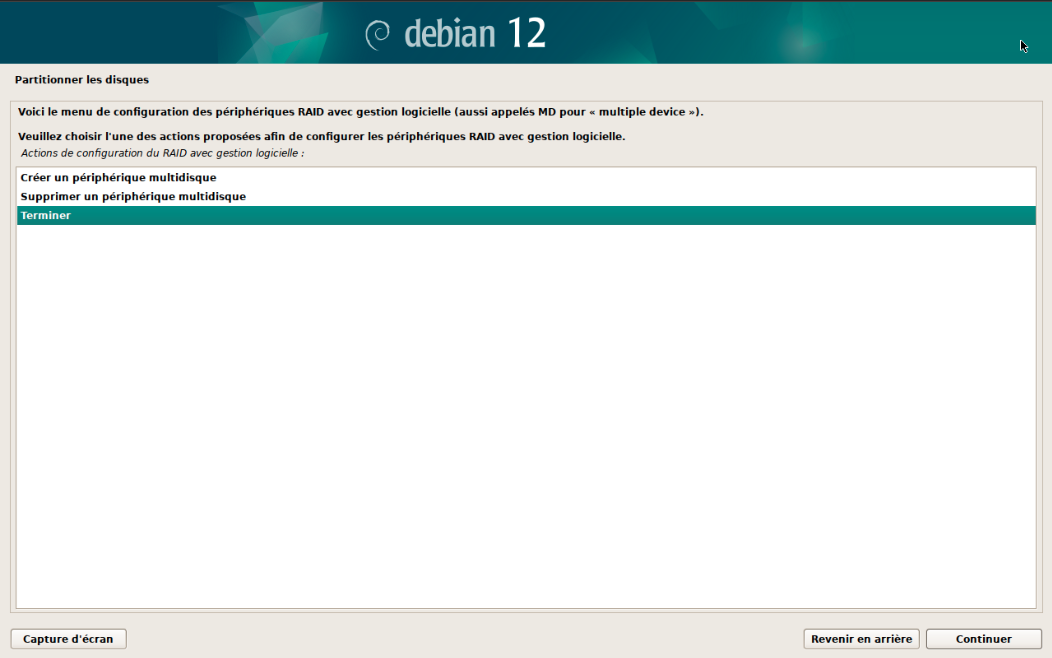

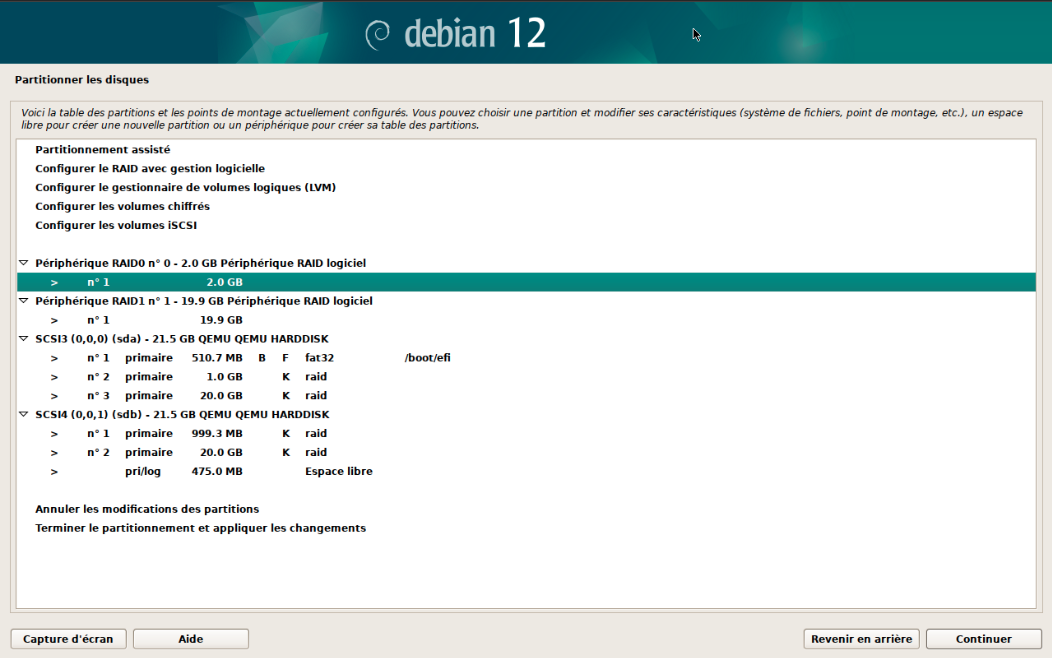

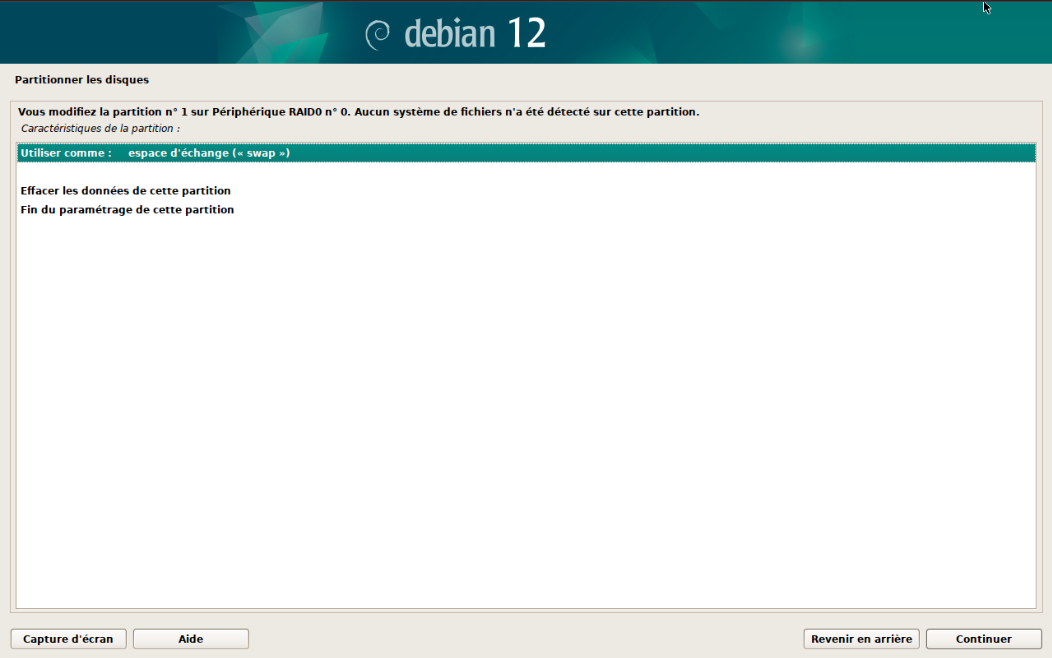

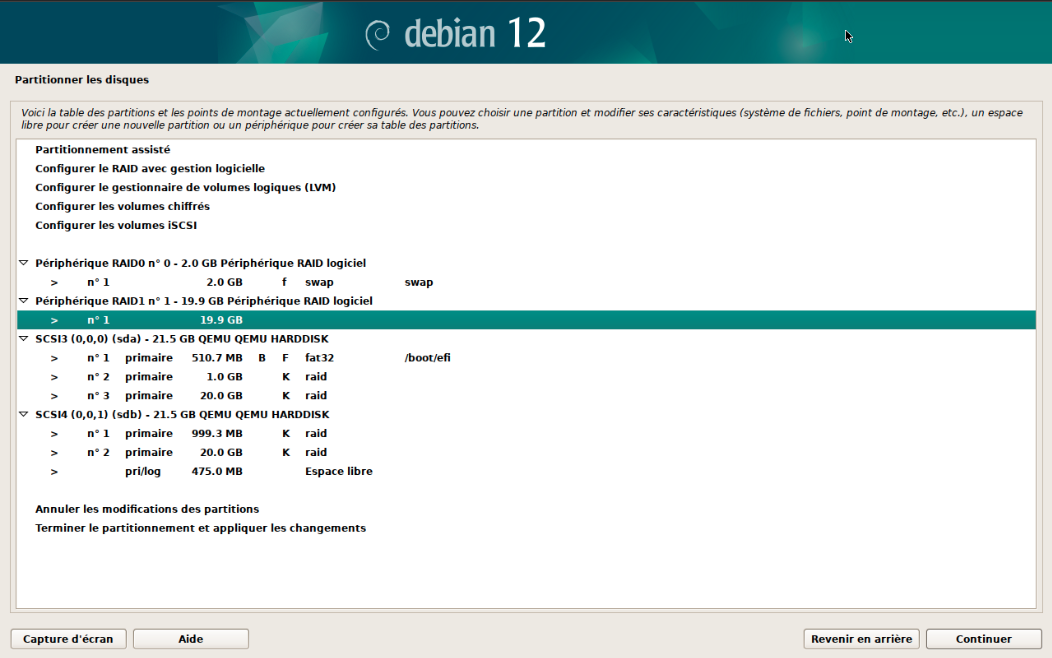

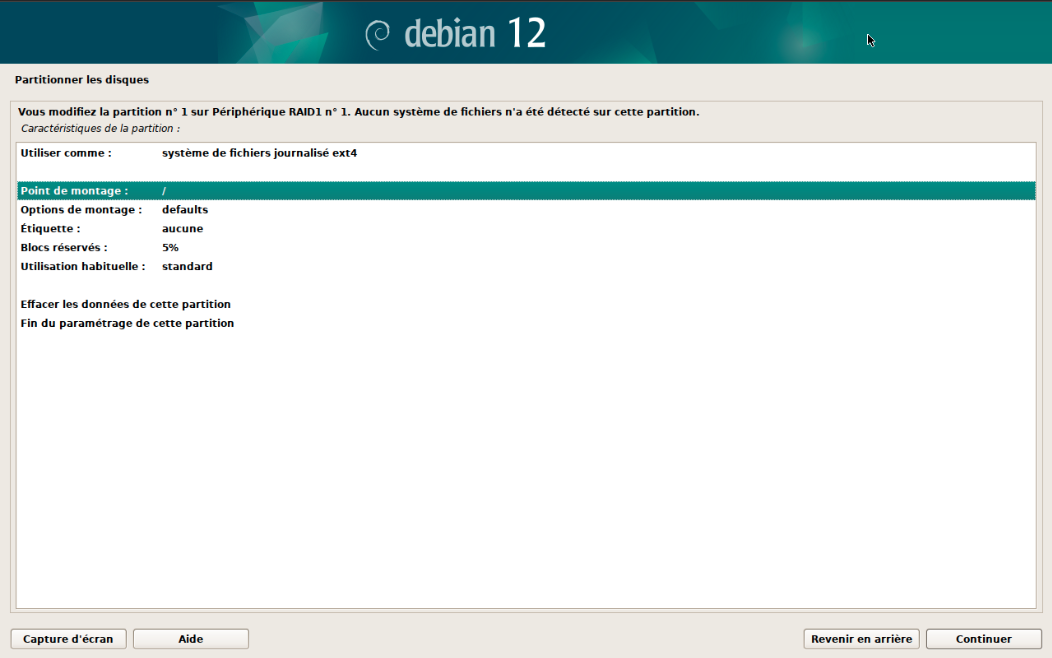

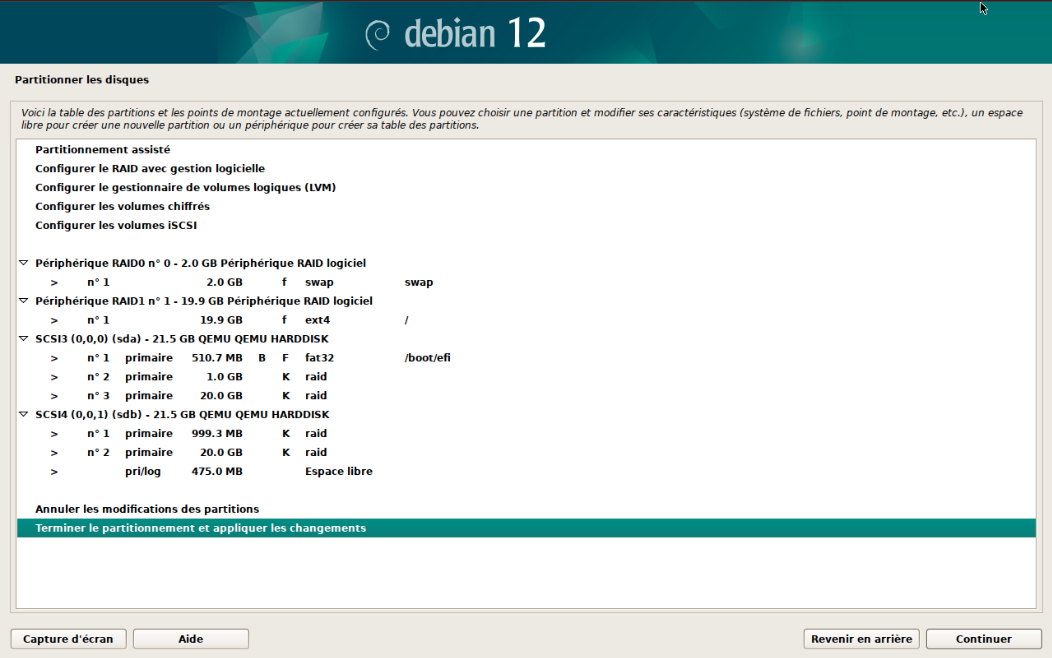

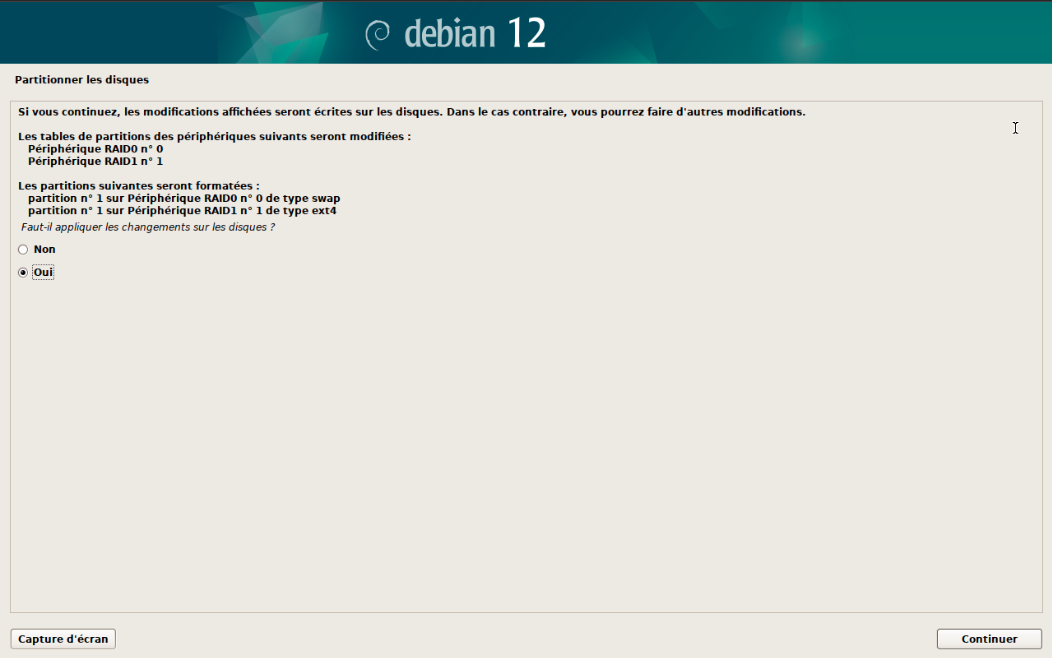

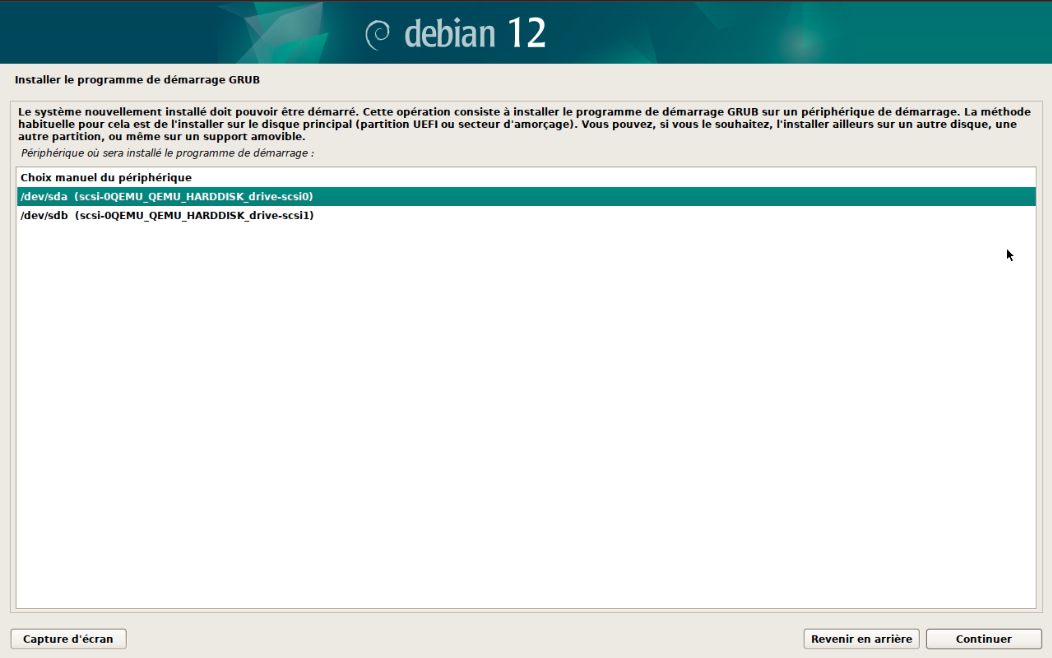

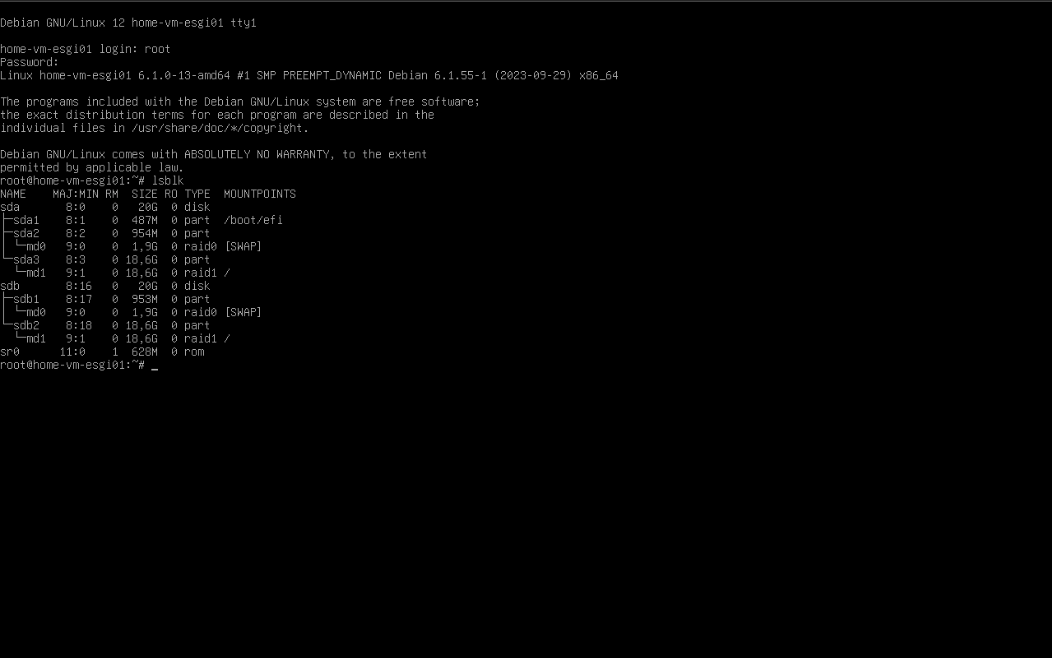

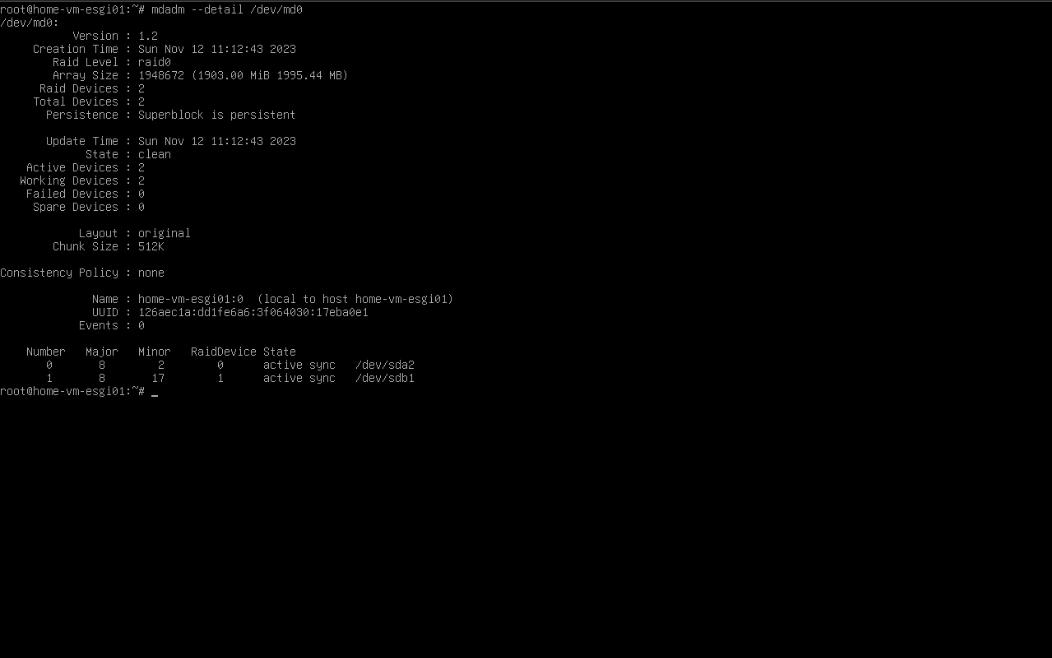

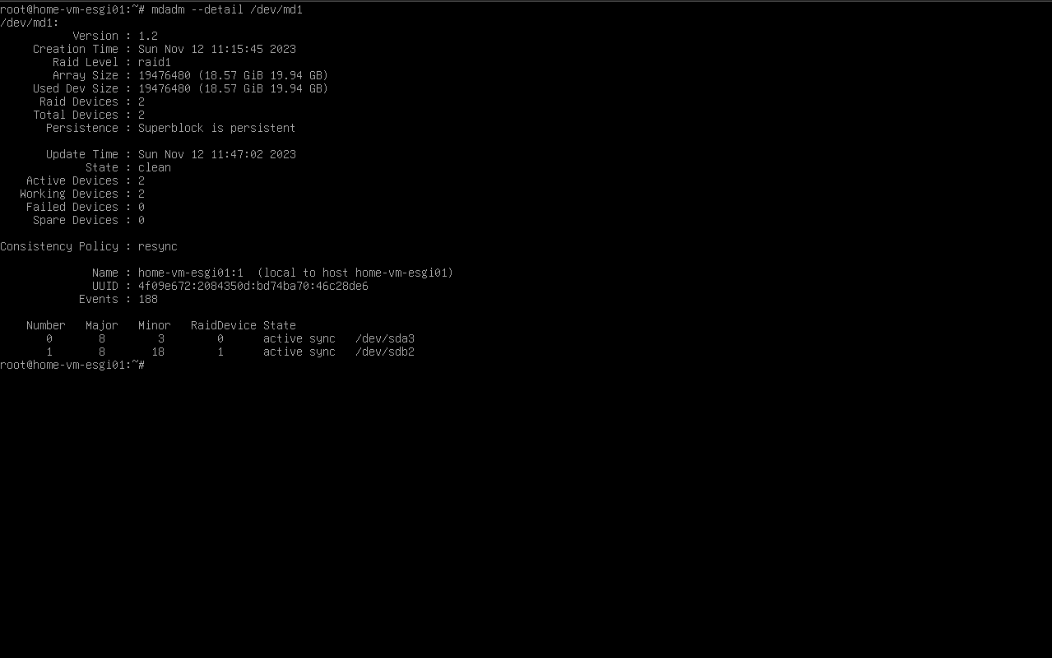

On peut maintenant **Configurer le RAID avec gestion logicielle** : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/rmsimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/R2dimage.png) On commence par le **RAID0** de la SWAP : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/7r1image.png) On sélectionnes les deux partitions de 1Go : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/BDmimage.png) On réitère l'opération pour le RAID du système: [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/PGUimage.png) Cette fois on configure un **RAID1** : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/Iioimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/mHlimage.png) Dans notre configuration, nous n'aurons pas de disque de réserve (spare), laissez 0 : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/7Pfimage.png) On sélectionnes les deux partitions de 20Go : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/8xIimage.png) Et on peut **Terminer** la configuration des périphériques RAID : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/ir5image.png) Désormais, on sélectionne le **Périphérique RAID0** pour configurer la SWAP : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/uRnimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/fHaimage.png) Puis on sélectionne le **périphérique RAID1** pour configurer la racine du système : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/RU2image.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/6ubimage.png) On peut enfin **Terminer le partitionnement et appliquer les changements** : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/7TFimage.png) [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/YYsimage.png) Vous pouvez poursuivre l'installation du système de manière standard sauf pour l'installation de GRUB où vous allez devoir sélectionner le disque **/dev/sda** : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/90iimage.png) ## Vérification de la configuration Une fois le système redémarré, on peut s'assurer de la configuration des partitions grâce à la commande **lsblk** : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/0C1image.png) Puis on peut vérifier l'état du RAID0 grâce à la commande **mdadm --detail /dev/md0** : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/4Rzimage.png) Et enfin, l'état du RAID1 grâce à la commande **mdadm --detail /dev/md1** : [](https://wiki.neopipe.fr/uploads/images/gallery/2023-11/fcZimage.png) # [Debian] Serveur NTP ## Introduction Il peut être utile d'installer un serveur de temps sur un réseau lorsque vous faites des opérations qui nécessitent que les horloges de vos différents systèmes soient synchronisées. ## Installation serveur Commencez par installer le paquet **ntp** sur le serveur : ```bash apt update && apt install -y ntp ``` Puis passez à la configuration de votre serveur en éditant le fichier **/etc/ntpsec/ntp.conf**. Commencez par commenter (avec le #) les pools de Debian définis par défaut : ``` #pool 0.debian.pool.ntp.org iburst #pool 1.debian.pool.ntp.org iburst #pool 2.debian.pool.ntp.org iburst #pool 3.debian.pool.ntp.org iburst ``` Vous pouvez configurer un serveur de temps de strate supérieur (qui servira de référence) en ajoutant cette ligne : ``` serverPensez à supprimer les restrictions par défaut.

Puis il faut en dernier lieu utiliser **fudge** afin de rafraîchir automatiquement l'horloge et définir le niveau de strate : ``` fudge 127.127.0.1 9 ``` On peut ensuite redémarrer et activer le serveur de temps pour prendre en compte notre configuration : ```bash systemctl enable --now ntp ``` ## Configuration client #### Debian Installez les paquets **ntp** et **ntpdate** : ```bash apt update && apt install -y ntp ntpdate ``` Puis configurez le serveur à utiliser en éditant le fichier **/etc/ntpsec/ntp.conf** : ``` serverLa valeur doit être égale à la racine carré du nombre de seconde que vous souhaitez (ex: pour un rafraîchissement toutes les 16 secondes la valeur sera égale à 4 car 2^**4** = 16).

On peut ensuite redémarrer le service ntp et interroger le serveur avec ntpdate : ```bash systemctl restart ntp ``` ```bash ntpdateLes fichiers html et css de votre site web sont stockées dans **/var/www/html** .

Vous pouvez accéder à votre site web en saisissant l'adresse IP de votre machine Debian dans l'URL de votre navigateur en utilisant le protocole http : ``` http://Pensez à vérifier la version de php en utilisant la commande **"ls /run/php"**.

Enfin, n'oubliez pas de redémarrer les services pour appliquer les changements : ```bash sudo systemctl restart php8.2-fpm nginx ``` # [Debian] ELK ## Introduction La suite **ELK** pour **Elastic Logstash et Kibana** est un ensemble d'outil de sécurité qui permettent de collecter, indexer, parser et afficher les logs. Ces outils sont complémentaires et primordiaux pour la **blue team**. [](https://wiki.neopipe.fr/uploads/images/gallery/2023-12/lwcimage.png) ## Sources - [Documentation officielle - Installation Elasticsearch](https://www.elastic.co/guide/en/elasticsearch/reference/current/deb.html) - [Documentation officielle - Installation Logstash](https://www.elastic.co/guide/en/logstash/current/installing-logstash.html) - [Documentation officielle - Installation Kibana](https://www.elastic.co/guide/en/kibana/current/deb.html) ## Installation #### Prérequis Tout d'abord, il faut importer la **clé GPG** pour être en mesure d'installer les outils de la suite ELK : ```bash wget -qO - https://artifacts.elastic.co/GPG-KEY-elasticsearch | gpg --dearmor -o /usr/share/keyrings/elasticsearch-keyring.gpg && apt-get install apt-transport-https && echo "deb [signed-by=/usr/share/keyrings/elasticsearch-keyring.gpg] https://artifacts.elastic.co/packages/7.x/apt stable main" | tee /etc/apt/sources.list.d/elastic-7.x.list && apt-get update ``` #### Elasticsearch Voici la commande pour installer **Elasticsearch** : ```bash apt install -y elasticsearch ``` Démarrez et activez le service elasticsearch : ```bash systemctl enable --now elasticsearch ```La configuration globale d'elasticsearch se trouve dans le fichier **/etc/elasticsearch/elasticsearch.yml** .

Ensuite, configurez le mot de passe de l'utilisateur **elastic** grâce à cette commande : ```bash /usr/share/elasticsearch/bin/elasticsearch-reset-password -u elastic -i ```Le service est désormais disponible depuis le navigateur en vous rendant sur **https://<IP>:9200** .

#### Logstash Voici la commande pour installer **Logstash** : ```bash apt install -y logstash ```Logstash peut être configuré à travers le fichier **/etc/logstash/conf.d/beats.conf** .

Démarrez et activez le service logstash : ```bash systemctl enable --now logstash ```Le service est désormais disponible sur le port **5044** .

#### Filebeat Voici la commande pour installer **Filebeat** : ```bash apt install -y filebeat ```Logstash peut être configuré à travers le fichier **/etc/filebeat/filebeat.yml** .

Démarrez et activez le service filebeat : ```bash systemctl enable --now filebeat ``` #### Kibana Voici la commande pour installer **Kibana** : ```bash apt install -y kibana ```Kibana peut être configuré à travers le fichier **/etc/kibana/kibana.yml** .

Démarrez et activez le service kibana : ```bash systemctl enable --now kibana ```Le service est désormais disponible sur l'url **http://<IP>:5601** .

Pour activer Kibana, il vous sera demandé un token d'enrollement qui peut être généré grâce à la commande suivante : ```bash /usr/share/kibana/bin/kibana-verification-code ``` Ensuite, un code de vérification vous sera demandé, tapez cette commande pour l'obtenir : ```bash /usr/share/elasticsearch/bin/elasticsearch-create-enrollment-token -s kibana ``` # [Debian] Mauvais écran connexion ## Introduction Il se peut qu'après une nouvelle installation vous ayez le mauvais écran pour l'écran de verrouillage. Dans ce cas vous pouvez essayer la technique ci-dessous. ## Résolution Copier la configuration locale dans le dossier de configuration de GDM : ``` sudo cp .config/monitors.xml /var/lib/gdm3/.config/ ```Si **/var/lib/gdm3** n'existe pas, essayez avec **/var/lib/gdm** !

Puis redémarrez GDM pour vérifier que la manipulation a fonctionnée : ``` sudo systemctl restart gdm ``` # [Debian] Flatpak ## Introduction Les dépôts **Flatpak** permettent d'étendre votre logithèque et d'installer des logiciels non disponibles normalement. [](https://wiki.neopipe.fr/uploads/images/gallery/2024-01/sRKimage.png) ## Installation Tout d'abord, installez le paquet **flatpak** : ``` apt install -y flatpak ``` Puis ajoutez le dépôts **flathub** : ``` flatpak remote-add --if-not-exists flathub https://dl.flathub.org/repo/flathub.flatpakrepo ``` ## Manuel Pour installer un paquet flatpak : ``` flatpak installLe serveur VPN est prêt à être utilisé !

Vous pouvez créer de nouveaux clients en exécutant de nouveau le script.

## Installation des clients #### Windows - [OpenVPN - Windows download](https://openvpn.net/client/client-connect-vpn-for-windows/) ##### Debian ```bash apt install -y openvpn ``` ```bash openvpnVous pouvez réitérer les deux commandes ci-dessus pour générer une paire clé privée/publique pour chaque hôte du réseau VPN.

Ensuite, pour chaque hôte, ajoutez cela dans la configuration du serveur : ``` [Peer] PublicKey =Remplacez les champs appropriés par vos valeurs.

## Utilisation ```bash sshs ``` # [Debian] GlusterFS ## Introduction **GlusterFS** permet de créer des espaces de données partagées ce qui peut servir pour faire répliquer deux partitions identiques entre deux serveurs distants. ## Source - [Tutoriel - Installer GlusterFS sur Debian 11](https://shape.host/resources/optimize-filesystem-scalability-install-glusterfs-debian-11) ## Installation du cluster Pour la haute disponibilité il est recommandé d'utiliser au moins trois instances sur lesquels nous aurons notre partitions partagée. Pour le tutoriel nous utiliserons trois machines sur **Debian 11**. - Tout d'abord, toutes les machines du cluster doivent posséder un hostname, pour cela on définit le hostname avec la commande suivante : ```bash hostnamectl set-hostnameVérifiez que le ping fonctionne en utilisant les noms d'hôtes.

Ensuite, nous devons préparer la partition qui va accueillir les données sur les trois machines (notre disque sera **/dev/sdb**) : ```bash apt install -y parted ``` ```bash parted /dev/sdb mklabel gpt mkpart SHARE ext4 1MiB 100% ``` Maintenant, nous devons préparer le dossier qui va accueillir le point de montage (ici **/share**) : ```bash mkdir /share ``` Puis ajoutez cela dans le **/etc/fstab** pour être persistant après redémarrage : ``` /dev/sdb1 /share ext4 defaults 0 1 ``` Pour appliquer les changements et détecter les erreurs : ```bash mount -a ```Ne laissez pas d'erreur, sinon vous risquez de ne pas pouvoir démarrer au prochain redémarrage du système !

Créer le dossier **/share/brick0** qui va accueillir les fichiers partagés : ```bash mkdir -p /share/brick0 ``` Désormais, nous pouvons installer le **serveur GlusterFS** sur nos trois machines : ```bash apt install -y gnupg2 apt-transport-https software-properties-common curl && curl https://download.gluster.org/pub/gluster/glusterfs/10/rsa.pub | gpg --dearmor > /usr/share/keyrings/glusterfs-archive-keyring.gpg && DEBID=$(grep 'VERSION_ID=' /etc/os-release | cut -d '=' -f 2 | tr -d '"') && DEBVER=$(grep 'VERSION=' /etc/os-release | grep -Eo '[a-z]+') && DEBARCH=$(dpkg --print-architecture) && echo "deb [signed-by=/usr/share/keyrings/glusterfs-archive-keyring.gpg] https://download.gluster.org/pub/gluster/glusterfs/LATEST/Debian/${DEBID}/${DEBARCH}/apt ${DEBVER} main" | sudo tee /etc/apt/sources.list.d/gluster.list && apt update && apt install -y glusterfs-server ``` Activer le service et démarrez le : ```bash systemctl enable --now glusterd ``` ``` systemctl enable glusterd ``` On peut initialiser le cluster depuis le premier noeud (Node 1) du cluster avec la commande suivante : ```bash gluster peer probeOn peut vérifier que les noeuds ont bien rejoins le cluster avec la commande **gluster pool list** .

On peut vérifier l'état du cluster avec la commande **gluster peer status** .

On peut maintenant créer un premier volume partagé ```bash gluster volume createOn peut afficher les informations du volume avec la commande **gluster volume info** .

## Montage côté client Comme on le ferait avec un partage réseau type NFS ou Samba par exemple, nous allons monter notre volume glusterfs sur notre ou nos clients. Pour cela, on installe d'abord le paquet **glusterfs-client** : ```bash apt install -y glusterfs-client ``` On peut créer le point de montage : ```bash mkdir -p /mnt/share ``` Et on monte le volume : ```bash mount.glusterfsLe volume distribué est prêt et tolère la panne pour supporter la **HA** !

# [Debian] Corosync ## Introduction **Corosync** permet de faire de la haute disponiblité sur vos services systemd ce qui peut être utile pour un serveur web ou une base de données par exemple. À noter que corosync est utilisé par Proxmox pour sa HA. ## Installation # [Debian] OpenSSL ## Introduction Openssl est une bibliothèque standard de chiffrement disponible sur les systèmes Unix. [](https://wiki.neopipe.fr/uploads/images/gallery/2024-10/image.png) ## Chiffrement de fichier Vous pouvez chiffrer un fichier en AES-256-CBC avec un mot de passe grâce à la commande suivante : ```bash openssl enc -aes-256-cbc -salt -pbkdf2 -inVous pouvez créer les entrées correspondantes dans le **/etc/fstab** .

#### Ajout d'un disque Admettons que je manque d'espace sur mon volume logiques correspondant à mes musiques (lv\_musics), je vais ajouter un disque dans mon serveur, puis je vais l'initialiser : ```bash wipefs -a /dev/sdZ && pvcreate /dev/sdZ ``` Ajoutez le volume physique à votre groupe de volumes : ```bash vgextend vg_medias /dev/sdZ ``` Puis agrandissez votre volume logique : ```bash lvextend -L +500G /dev/vg_medias/lv_musics && resize2fs /dev/vg_medias/lv_musics ```Si vous souhaitez redimensionner un volume logique formaté en XFS, utilisez **xfs\_growfs** <MOUNT\_POINT>. Cela paraît contre intuitif mais le volume doit être monté pour être redimensionné. Mettez bien le point de montage et pas l'identifiant du disque !

#### Supprimer un volume logique ```bash umount /mnt/musics && lvremove /dev/vg_medias/lv_musics ``` #### Debug Affichez les volumes physiques : ```bash pvs ``` Affichez les groupes de volumes : ```bash vgs ``` Ou : ```bash vgdisplay ``` Affichez les volumes logiques : ```bash lvs ``` # [Debian] LUKS ## Introduction LUKS permet le chiffrement de partition sur les systèmes Linux. ## Installation #### Debian ```bash apt install -y cryptsetup ``` ## Manuel #### Création partition ```bash fdisk /dev/sdX ``` Puis N > P > ENTER > ENTER > ENTER. #### Chiffrement partition ```bash cryptsetup luksFormat --cipher aes-xts-plain64 --key-size 256 --hash sha256 --verify-passphrase /dev/sdhX1 ``` #### Déchiffrement partition ```bash cryptsetup luksOpen /dev/sdX1 sdX1_crypt ```Par défaut, le nom du volume chiffré s'appelle **sdX\_crypt**.

#### Formatage partition ```bash mkfs.ext4 /dev/mapper/sdX_crypt ``` #### Montage partition mount /dev/mapper/sdX\_crypt ```bash mount /dev/mapper/sdX_crypt /mnt/crypt_part ``` # [Debian] Raid ZFS ## Introduction Le raid avec ZFS est considéré comme plus performant et plus moderne donc recommandable. [](https://wiki.neopipe.fr/uploads/images/gallery/2026-02/image.png) ## Raid1 #### Identification des disques ```bash lsblk -o NAME,SIZE,MODEL,SERIAL ``` ```bash ls -l /dev/disk/by-id/ | grep -E 'sda|sdb' ```Notez les identifiants (ata-XXXXX).

#### Construction du raid Ici le pool s'appellera **data** : ```bash zpool create -f -o ashift=12 data mirror /dev/disk/by-id/Les datasets sont un peu comme les sous-volumes BTRFS, on peut y appliquer des *quotas* etc.

#### Suppression d'un dataset ```bash zfs destroy data/series ```